IA Conversationnelle : Définition, Enjeux et Applications

Table des matières

Transcribe, Translate & Summarize in Seconds

Table des matières

Transcribe, Translate & Summarize in Seconds

La technologie d'IA conversationnelle a révolutionné les systèmes de support client, remplaçant les canaux traditionnels comme les appels téléphoniques et les emails par des assistants virtuels intelligents et réactifs. Les entreprises mettent de plus en plus en œuvre des solutions d'IA conversationnelle pour offrir des services personnalisés à tous les points de contact avec les clients, disponibles 24h/24 et 7j/7 sans interruption. Selon les recherches de Gartner, l'IA conversationnelle gérera plus de 70% des interactions avec les clients d'ici 2027, démontrant l'adoption rapide de cette technologie transformative dans les applications de service client.

Dans ce blog, nous explorerons les composants fondamentaux des systèmes d'IA conversationnelle, examinerons comment ces plateformes intelligentes traitent l'information grâce au traitement du langage naturel, et étudierons les applications concrètes qui transforment les industries aujourd'hui.

Qu'est-ce que l'IA conversationnelle ?

L'IA conversationnelle représente des systèmes d'intelligence artificielle avancés qui engagent des conversations naturelles, semblables à celles des humains, avec les utilisateurs. Ces systèmes traitent les entrées textuelles ou vocales, comprennent l'intention de l'utilisateur grâce à l'analyse contextuelle, et génèrent des réponses pertinentes en temps réel tout en apprenant continuellement de chaque interaction.

L'évolution de l'IA conversationnelle a progressé des simples chatbots basés sur des règles comme ELIZA dans les années 1960 aux systèmes sophistiqués d'aujourd'hui. L'IA conversationnelle moderne, tout comme dans le doublage IA, utilise le traitement du langage naturel, l'apprentissage profond et l'informatique en nuage pour fournir une compréhension contextuelle et des réponses personnalisées. Les assistants virtuels IA comme Siri, Alexa et Google Assistant ont étendu cette technologie au-delà du texte avec l'intégration de voix IA avancées, faisant de l'IA conversationnelle une partie intégrante de la vie quotidienne.

Composants essentiels de l'IA conversationnelle

Derrière les chatbots IA efficaces se trouve un cadre de technologies travaillant ensemble pour comprendre et répondre aux conversations humaines. Ces composants forment la base des systèmes modernes d'IA conversationnelle :

Traitement du Langage Naturel (NLP)

Le NLP permet à l'IA conversationnelle d'interpréter le langage humain dans sa forme naturelle. Lorsque les utilisateurs envoient des messages ou énoncent des commandes, le NLP décompose ce langage pour déterminer le sens et l'intention. Cette technologie aide l'IA à reconnaître les besoins des utilisateurs même avec des formulations inhabituelles, en utilisant des techniques comme la tokenisation, la reconnaissance d'intention et l'analyse de sentiment. Les modèles NLP avancés suivent l'historique des conversations pour maintenir le contexte à travers les échanges, permettant des interactions plus naturelles.

Apprentissage automatique dans les systèmes d'IA

L'apprentissage automatique donne aux systèmes d'IA conversationnelle la capacité de s'améliorer avec le temps. Plutôt que d'utiliser des scripts rigides, ces systèmes s'entraînent sur des ensembles de données de conversations réelles, apprenant comment les gens communiquent naturellement. Grâce aux interactions continues, l'IA conversationnelle affine sa compréhension, s'adaptant aux nouvelles variations linguistiques, à l'argot et aux dialectes régionaux pour créer des expériences de plus en plus réactives.

Technologie de reconnaissance vocale

La technologie de reconnaissance vocale (ASR) est essentielle pour les assistants conversationnels vocaux. Elle convertit le langage parlé en texte que l'IA peut traiter via le NLP. Les systèmes ASR modernes atteignent une haute précision en utilisant l'apprentissage profond entraîné sur divers échantillons de parole, s'adaptant à différents accents, vitesses d'élocution et bruits de fond pour des interactions vocales fiables dans des environnements variés.

Comment fonctionne l'IA conversationnelle ?

Les systèmes d'IA conversationnelle suivent un flux de travail structuré pour comprendre, interpréter et répondre aux demandes des utilisateurs. Ce processus fonctionne à travers trois phases principales — le traitement des entrées, la génération de réponses et la livraison des sorties — chacune alimentée par des modèles de langage spécialisés, des algorithmes d'apprentissage automatique et des technologies de traitement de la parole.

La phase d'entrée

La phase d'entrée commence lorsque les utilisateurs interagissent avec l'IA conversationnelle via des messages texte ou des commandes vocales adressées aux assistants vocaux intelligents. Pour les systèmes basés sur le texte, l'IA analyse directement les entrées écrites, tandis que les interactions vocales nécessitent une conversion préliminaire de la parole en texte grâce à la technologie ASR.

Une fois que l'entrée devient disponible dans un format traitable, le système de NLP effectue une analyse complète pour identifier les éléments d'information clés :

- Mots-clés critiques indiquant le sujet

- L'intention sous-jacente de l'utilisateur motivant la demande

- Le sentiment émotionnel véhiculé par les choix de langage

- La relation contextuelle avec les éléments de conversation précédents

L'IA conversationnelle avancée maintient une conscience contextuelle tout au long des interactions. Ces systèmes conservent les détails pertinents des échanges antérieurs, leur permettant de répondre aux questions de suivi et de gérer des dialogues à plusieurs tours avec un flux de conversation naturel imitant les modèles d'interaction humaine.

La phase de traitement

Après avoir compris les demandes des utilisateurs, l'IA conversationnelle entre dans la phase de traitement où la détermination de la réponse a lieu. Les modèles de langage d'IA, en particulier les grands modèles de langage (LLM), génèrent des réponses en prédisant les répliques les plus contextuellement appropriées et naturelles basées sur l'intention identifiée de l'utilisateur et l'historique accumulé de la conversation.

De nombreux systèmes conversationnels intègrent des arbres de décision prédéfinis et des flux de conversation pour des interactions structurées telles que la planification de rendez-vous ou le traitement des commandes. Ces cadres assurent un traitement cohérent des scénarios courants tout en maintenant la qualité de l'interaction en langage naturel.

La phase de sortie

Dans la phase finale, l'IA conversationnelle délivre des réponses aux utilisateurs soit par affichage de texte, soit par synthèse vocale. Les réponses textuelles apparaissent directement dans les interfaces de chat, tandis que les interactions vocales utilisent la technologie de synthèse vocale pour convertir le texte généré en parole naturelle.

Les moteurs modernes de synthèse vocale créent des réponses vocales de plus en plus semblables à celles des humains avec une intonation, un rythme et des qualités émotionnelles appropriés. Cette technologie de sortie avancée contribue significativement à créer des expériences de conversation fluides qui se rapprochent des modèles de communication humaine naturelle.

Applications réelles de l'IA conversationnelle

L'IA conversationnelle a transformé l'interaction homme-machine dans les environnements tant grand public que professionnels. Des assistants virtuels aux chatbots de service client, ces applications sont devenues de plus en plus courantes dans la vie quotidienne.

Assistants virtuels IA dans la vie quotidienne

Les assistants virtuels IA comme Amazon Alexa, Google Assistant et Siri d'Apple sont devenus des outils essentiels pour des millions d'utilisateurs. Grâce à de simples commandes vocales, ces systèmes gèrent des tâches quotidiennes, de la configuration de rappels au contrôle des appareils domestiques intelligents.

L'intégration de la maison intelligente représente un domaine de croissance majeur pour l'IA conversationnelle. Selon Statista, la technologie de maison intelligente atteindra 92,5% des foyers d'ici 2029, les assistants IA devenant des centres névralgiques pour la gestion des appareils connectés via des interfaces vocales intuitives.

Applications professionnelles de l'IA conversationnelle

Dans les environnements professionnels, les chatbots IA gèrent désormais des millions d'interactions de service client quotidiennement. Ces systèmes automatisés fournissent un support instantané sans intervention humaine, améliorant l'efficacité tout en maintenant la qualité du service.

L'assistant IA Erica de Bank of America démontre efficacement cet impact, traitant plus de 1,5 milliard d'interactions clients depuis son lancement. Les plateformes de commerce électronique comme Amazon et Sephora utilisent l'IA conversationnelle pour fournir des recommandations d'achat personnalisées basées sur l'historique des clients, améliorant l'expérience utilisateur et augmentant les taux de conversion.

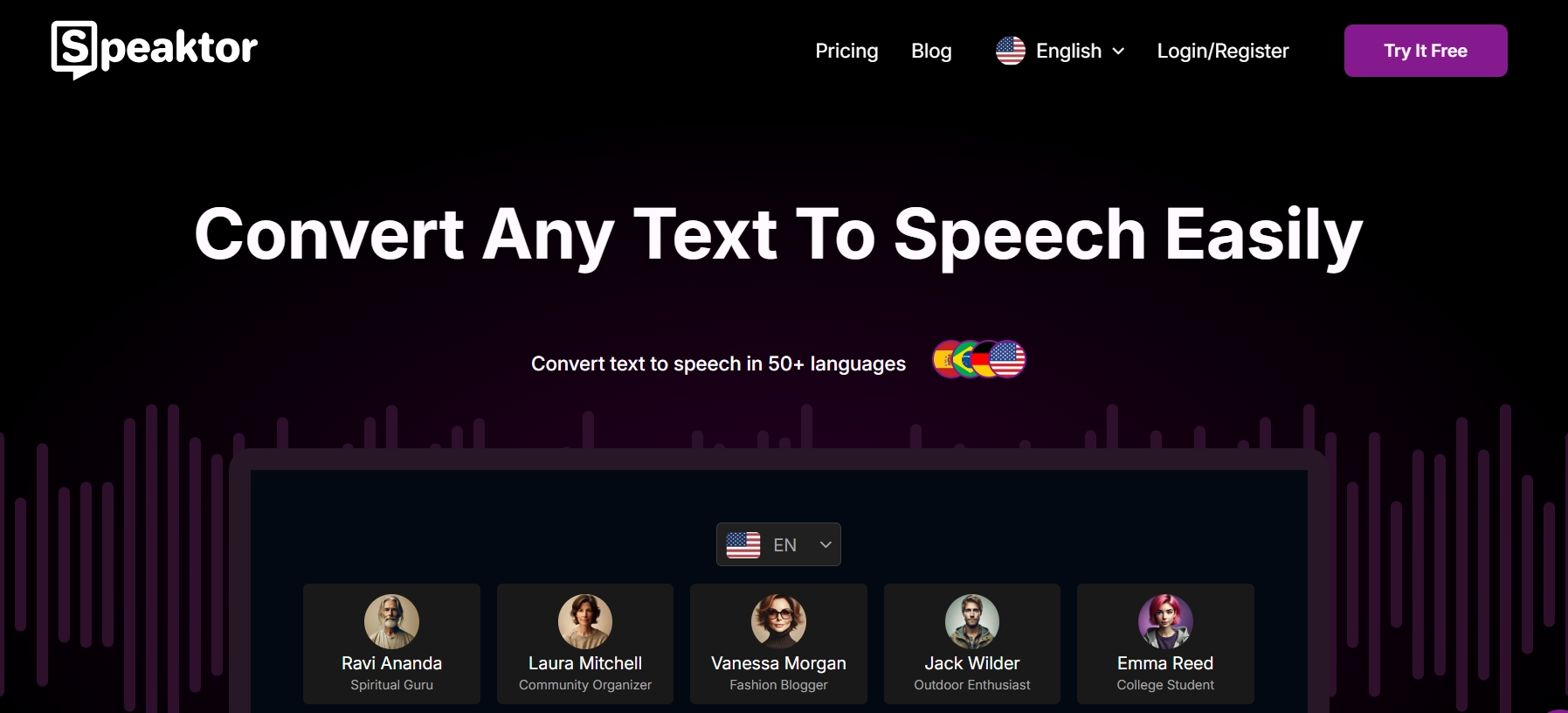

Les meilleurs outils de synthèse vocale pour l'IA conversationnelle

L'IA conversationnelle moderne fournit des réponses aux utilisateurs soit par affichage de texte, soit par synthèse vocale. Les réponses textuelles sont affichées directement dans les interfaces de chat, tandis que les interactions vocales utilisent la technologie de synthèse vocale pour convertir le texte en parole naturelle. Ces outils transforment le contenu écrit en discours naturel, améliorant l'accessibilité et l'engagement dans diverses applications.

Les meilleures solutions de synthèse vocale comprennent :

- Speaktor - Plateforme multilingue polyvalente avec une personnalisation vocale étendue

- Google Text-to-Speech - Solution largement intégrée avec un large support linguistique

- Amazon Polly - Service basé sur le cloud avec technologie vocale neuronale

- IBM Watson Text to Speech - Solution d'entreprise avec détection des émotions

- Microsoft Azure Text to Speech - Plateforme complète avec capacités de traduction

Comparaison des meilleures plateformes de synthèse vocale

Speaktor

Speaktor offre une technologie de synthèse vocale avancée avec des résultats remarquablement humains pour les créateurs de contenu, les entreprises, les éducateurs et les défenseurs de l'accessibilité.

Avantages :

- Prend en charge plus de 50 langues pour la création de contenu mondial

- Propose plus de 100 options vocales avec différents styles et tons

- Plusieurs formats de téléchargement (MP3, WAV, MP3+TXT, WAV+TXT)

- Traite le texte de diverses sources (saisie directe, documents, PDF, images)

- Indépendant de la plateforme avec intégration au stockage cloud

Inconvénients :

- Plus récent sur le marché que certains concurrents

- Peut nécessiter une connexion internet pour une fonctionnalité complète

- Les fonctionnalités avancées peuvent nécessiter un abonnement payant

Speaktor améliore l'accessibilité pour les personnes malvoyantes tout en augmentant la productivité grâce à la création de voix off automatisée qui permet d'économiser un temps et des ressources considérables.

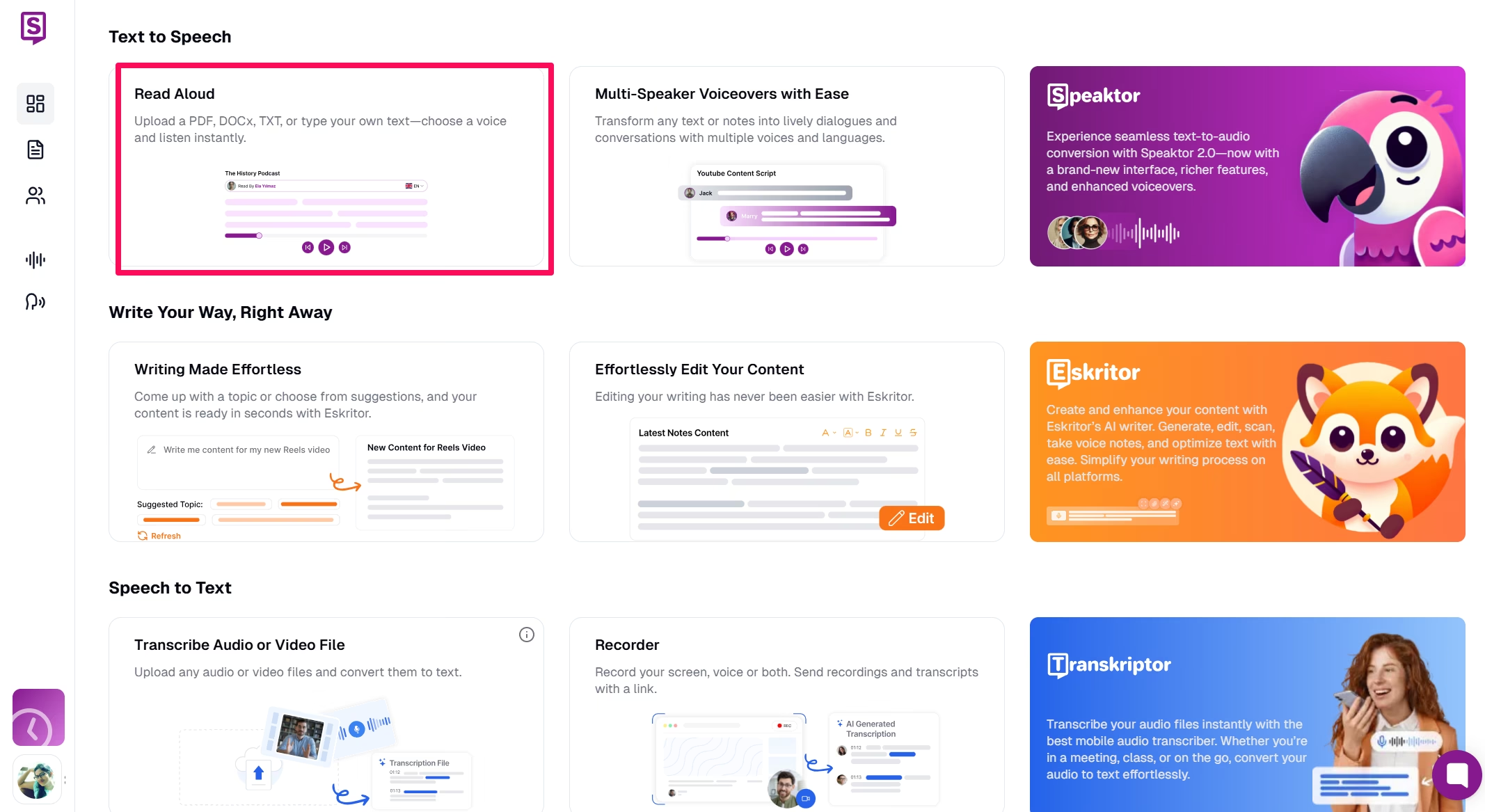

Comment fonctionne Speaktor

Speaktor utilise un flux de travail simplifié :

- Téléchargez ou saisissez du contenu textuel

- Sélectionnez la langue parmi les options disponibles <image5>

- Choisissez les caractéristiques vocales

- L'IA traite le texte pour générer une parole naturelle

- Téléchargez ou intégrez l'audio terminé <image6>

Google Text-to-Speech

La synthèse vocale de Google est intégrée dans les appareils Android, Google Assistant et les fonctionnalités d'accessibilité avec plus de 220 voix dans plus de 40 langues.

Avantages :

- Support linguistique et vocal étendu

- Voix WaveNet pour des modèles de parole naturels

- Intégration transparente avec l'écosystème Google

- Gratuit pour une utilisation de base et à des fins d'accessibilité

Inconvénients :

- Les fonctionnalités avancées nécessitent l'API Cloud TTS (payante)

- Personnalisation limitée par rapport aux solutions d'entreprise

- Moins de contrôle sur les caractéristiques vocales

Google TTS excelle dans les applications d'accessibilité tout en fournissant aux développeurs des outils d'implémentation via l'API Cloud Text-to-Speech.

Amazon Polly

Amazon Polly fournit une synthèse vocale basée sur le cloud utilisant l'apprentissage profond pour des résultats naturels, idéal pour les livres audio, les assistants virtuels et le support client.

Avantages :

- Technologie vocale neuronale pour une parole réaliste

- Support SSML pour un contrôle précis des caractéristiques vocales

- Capacités de streaming en temps réel

- Intégration transparente avec AWS

Inconvénients :

- Tarification plus élevée par rapport aux alternatives

- Nécessite des connaissances AWS pour une implémentation optimale

- Meilleures fonctionnalités limitées aux niveaux payants

La plateforme excelle dans le support SSML, permettant un contrôle précis de la prononciation, du volume, de la hauteur et du débit de parole tout en offrant une fiabilité de niveau entreprise.

IBM Watson Text to Speech

IBM Watson Text to Speech propose des solutions orientées entreprise avec formation vocale personnalisée, modulation vocale basée sur les émotions et options de déploiement sécurisées.

Avantages :

- Précision de prononciation supérieure pour la terminologie spécialisée

- Capacités de détection des émotions

- Fonctionnalités de sécurité de niveau entreprise

- Options de personnalisation avancées

Inconvénients :

- Structure de coûts plus élevée

- Implémentation plus complexe

- Moins d'options vocales que certains concurrents

Watson TTS excelle particulièrement dans les industries avec des exigences de vocabulaire spécifiques comme la santé, la finance et la technologie, tout en créant des interactions nuancées qui répondent de manière appropriée aux états émotionnels des utilisateurs.

Microsoft Azure Text to Speech

Microsoft Azure Text to Speech offre un développement vocal neuronal personnalisé, un support multilingue et une traduction en temps réel au sein de l'écosystème d'IA de Microsoft.

Avantages :

- Fonctionnalité Custom Neural Voice pour des voix spécifiques à la marque

- Excellentes capacités de traduction

- Intégration avec d'autres services Azure

- Support entreprise solide

Inconvénients :

- Tarif plus élevé

- Nécessite des connaissances de l'écosystème Azure

- Complexe pour les petites implémentations

Azure TTS est particulièrement précieux pour les centres d'appels, les plateformes d'e-learning et les technologies d'assistance, tout en permettant le développement de solutions d'IA complètes combinant plusieurs technologies conversationnelles.

Tendances futures de l'IA conversationnelle

L'IA conversationnelle continue d'évoluer rapidement avec plusieurs développements clés à l'horizon :

- L'IA multimodale traitera simultanément le texte, la voix, les images et la vidéo, permettant aux assistants IA d'interpréter les expressions faciales et les signaux émotionnels pour des interactions plus naturelles.

- Les agents IA autonomes passeront de capacités réactives à proactives, exécutant indépendamment des tâches complexes sans guidage humain constant. L'Auto-GPT d'OpenAI illustre cette tendance vers des systèmes d'IA autodirigés.

- D'ici cinq ans, l'IA conversationnelle deviendra pratiquement indiscernable des interactions humaines dans de nombreux contextes, les assistants IA évoluant vers des agents numériques autonomes et émotionnellement intelligents capables de gérer environ 95% des interactions du service client.

Conclusion

L'IA conversationnelle transforme fondamentalement l'interaction homme-machine en créant des canaux de communication plus naturels et efficaces. À mesure que les capacités de l'IA progressent, des systèmes de plus en plus sophistiqués s'intégreront parfaitement dans les routines quotidiennes, offrant des interfaces intuitives pour l'interaction numérique. Les organisations qui mettent en œuvre ces solutions obtiennent des avantages significatifs grâce à l'amélioration de l'expérience client et de l'efficacité opérationnelle.

Bien que de nombreuses plateformes de synthèse vocale existent aujourd'hui, Speaktor se distingue par sa facilité d'utilisation exceptionnelle, la qualité naturelle de sa voix et son support multilingue complet. Que ce soit pour la création de contenu, l'amélioration de l'accessibilité ou l'automatisation des entreprises, Speaktor offre des solutions audio fluides alimentées par l'IA pour divers besoins de mise en œuvre. Découvrez les capacités transformatrices de la technologie vocale avancée de l'IA conversationnelle — explorez Speaktor dès aujourd'hui !

Foire aux questions

L'IA conversationnelle désigne des systèmes d'intelligence artificielle qui permettent des interactions semblables à celles des humains par texte ou voix. Ces systèmes utilisent des technologies comme le traitement du langage naturel (NLP), l'apprentissage automatique (ML) et la reconnaissance vocale pour comprendre et répondre aux requêtes des utilisateurs en temps réel.

Les chatbots ordinaires suivent uniquement des règles prédéfinies et ne peuvent pas répondre à des questions hors de ces règles. L'IA conversationnelle, en revanche, peut comprendre le sens, poser des questions complémentaires et s'améliorer avec l'expérience. Cela rend les conversations plus utiles et réalistes.

L'IA conversationnelle fonctionne en trois étapes. D'abord, elle écoute ou lit ce qu'une personne dit. Ensuite, elle détermine le sens grâce à un cerveau intelligent appelé apprentissage automatique. Enfin, elle répond par du texte ou de la parole, comme dans une vraie conversation. Elle s'améliore avec le temps en apprenant des interactions passées.

La plupart des outils d'IA conversationnelle suivent des règles strictes de confidentialité pour protéger les données des utilisateurs. Cependant, certains assistants IA collectent des informations pour améliorer leurs services, il est donc important de vérifier les paramètres de confidentialité. De nombreuses entreprises utilisent le chiffrement et des mesures de sécurité pour protéger les conversations IA.