有名人の声生成ツール:リスク、規制、責任ある代替手段

Transcribe, Translate & Summarize in Seconds

Transcribe, Translate & Summarize in Seconds

TL;DR

有名人の声生成ツールは創造的ですが、詐欺、誤情報、ブランド損害、法的紛争などの大きなリスクを伴います

世界中の規制当局は、個人のアイデンティティの一部として声を保護するために迅速に動いています

音声AIの責任ある使用例には、アクセシビリティ(失われた音声の回復)、ローカライゼーション(多言語コンテンツ)、クリエイティブメディア(ストーリーテリング、教育、パロディ)があります

より安全な選択は、実在の人物の声をクローンせず、Speaktorのようなプラットフォームを選ぶことです。Speaktorは法的または倫理的リスクなしに50以上の言語で自然な合成音声を提供しています

有名人の声生成ツールは爆発的な人気を博し、誰でもポップスターにポッドキャストのナレーションをさせたり、有名俳優にグループチャットでジョークを言わせたりすることができるようになりました。

表面上、このツールは遊び心があり革新的に感じられます。しかし、その裏では、この技術はプライバシー、合法性、倫理に関する厄介な問題を提起しています。

有名人の声生成ツールは、トーン、リズム、個性を不気味なほど正確に模倣できる高度なAIモデルに依存しています。これにより、映画を複数の言語に吹き替えたり、オーディオブックをより魅力的にしたり、音声を失った人々に新しいコミュニケーション方法を提供したりするような創造的な使用例の扉が開かれます。

しかし、暗い側面もあります:クローンされた声はすでに詐欺、誤情報キャンペーン、無許可の推薦に悪用されています。有名人にとっては、評判と収入への直接的な脅威です。メディア、エンターテイメント、銀行業界などにとっては、規制と信頼の課題です。

有名人の声生成ツールはどのように機能するのか?

有名人の声生成ツールの核心には、AIを活用した音声合成があります。実際の人物の音声録音を取り込み、ニューラルネットワークを訓練して独自のパターンを模倣します。

このプロセスには2つの主要コンポーネントが含まれます:

- 音声クローニングモデル:ディープラーニングモデルが、ピッチ、トーン、リズム、アクセントなど、人の声の特徴を分析します。十分なサンプルがあれば、システムはその人の話し方の本質を捉えたデジタル音声指紋を構築します。

- テキスト音声変換(TTS)または音声間変換エンジン:モデルが声を学習すると、新しい音声を生成できるようになります。テキストを入力(TTS)したり、自分の音声入力を提供したりすると(音声間変換)、AIがクローンした有名人の声でそれを再現します。

最新のシステムでは、感情やイントネーションも捉えることができ、出力がロボット的ではなくより本物らしく聞こえるようになります。トレーニングとレンダリングはクラウドで行われることが多いため、消費者向けアプリを持つ誰でも数分以内に有名人のような音声を作成することができます。

有名人の声生成の一般的なリスクは何ですか?

1. 詐欺とサイバー犯罪

2024年の注目すべき事例では、多国籍企業の従業員が、クローンされたCFOが登場するディープフェイクのビデオ通話によって2500万ドル以上を送金するよう騙されました。偽の緊急通話やクローンされた声が、被害者からお金や機密情報を引き出すために使用されています。これらの攻撃は本物のように聞こえるため、従来のフィッシングよりも検出が難しいです。

2. 法的争い

人の声はアイデンティティの一部とみなされています。同意なく使用すると、パブリシティ権や肖像権を侵害し、訴訟につながる可能性があります。広告、ゲーム、映画などの業界では、有名人の声の無許可使用が契約違反となり、高額な法的紛争を引き起こす可能性があります。

3. ブランドダメージ

有名人のクローンされた声が、彼らが同意していない製品や意見を推薦しているように見える場合、有名人とブランドの両方に対する信頼を損なう可能性があります。企業にとって、無許可の声のクローニングとの関連は非倫理的とみなされ、顧客ロイヤルティを損なう可能性があります。

4. 誤情報

音声ディープフェイクは、虚偽の情報を広めたり世論を操作したりすることを容易にします。よく知られた声での説得力のある偽ニュースクリップや政治的声明は、人々が聞いたことを信じる傾向があるため、特に有害となり得ます。

5. セキュリティリスク

2024年から2025年にかけて、AIによる成りすまし詐欺は驚異的に148%増加しました。銀行や顧客サポートで広く使用されている音声認証システムは、現在脆弱な標的となっています。クローン化された声を使用することで、攻撃者は本人確認をすり抜け、機密アカウントへのアクセスを解除することができます。

有名人の声生成ツールに関する業界規制

アメリカ合衆国

- テネシー州のELVIS法(2024年):パフォーマーの声をAIの悪用から明示的に保護する最初の米国法。無許可のクローン化を犯罪行為とし、音楽レーベルやアーティスト組合の強力な支援を受けて推進されました。

- NO FAKES法 (2025年に再提出予定):個人の声や肖像の無許可AIレプリカを禁止する超党派の連邦法案。パロディやジャーナリズムのための例外を含みますが、被害者がアイデンティティの管理を取り戻すための削除プロセスを導入しています。

- TAKE IT DOWN法(2025年):主に同意のない親密な画像に焦点を当てていますが、TAKE IT DOWN法はディープフェイク規制が現在ワシントンの議題に確固として位置づけられていることを示し、より広範な保護のための基盤を築いています。

ヨーロッパ

- EU AI法(2024年施行):世界初の包括的なAI法。欺瞞的に使用される場合、ディープフェイク技術(音声クローンを含む)を「高リスク」に分類し、明確な開示とより厳格なコンプライアンスを要求しています。

- デンマークの法案(2025/26年):著作権法の画期的な改正案で、人々に自分の声、顔、肖像に対する明示的な所有権を与えるもの。無許可のクローン化の被害者は、削除と補償を要求できるようになります。この法案は他のEU諸国のモデルとなる可能性があります。

米国とヨーロッパを超えて、他の国々も有名人の声生成ツールや一般的な音声クローン化のリスクに対処するために迅速に動いています。

アジアからラテンアメリカまで、政策立案者たちはイノベーションとなりすまし詐欺や誤情報に対する保護のバランスを取る新しいルールを模索しています。

アプローチは様々ですが、世界的な傾向は明確です:業界規制当局は音声クローン化を、法的明確さと個人のための保護措置を必要とする重要な問題として扱っています。

有名人の声生成ツールをどのように利用すべきか?

- 明示的な同意を確保する:実在の人物の声を使用する意図がある場合は、本人または遺産管理者から書面による承認を得てください。これは法的または評判上の問題から最も明確に身を守る方法です。

- 視聴者に対して透明性を保つ:音声がAIで生成されたものであることを常に開示してください。簡単な免責事項は信頼を構築し、欺瞞の印象を避けることができます。

- 高リスク分野を避ける:政治的メッセージ、医療アドバイス、金融指示、商業的推薦は、ライセンスなしでは特に危険です。

- コンプライアンスを遵守したプラットフォームを選ぶ:ウォーターマーク、使用ログ、削除機能を提供するツールを利用し、悪用を真剣に受け止めていることを示しましょう。

有名人の声生成ツールはリスクを伴いますが、音声AI技術自体には意味のある倫理的な応用があります。

音声AIの責任ある使用例は何か?

アクセシビリティ

音声AIは、自然な発話能力を失った人々にコミュニケーション手段を提供します。過去の録音でモデルをトレーニングすることで、個人は自分の声を保存したり、復元したりすることができます。他の人々にとっては、自然な音声のAIが、スクリーンリーダー、支援機器、日常のデジタル対話をよりインクルーシブにします。

ご存知でしたか:

脳手術後、21歳のレクシー・ボーガンは話す能力を失いました。15秒の動画を使用して、研究者たちはOpenAIと協力し、彼女の10代の声を再現しました。現在彼女はアプリを通じてその声でコミュニケーションを取り、日常的なタスクをこなしています。

ローカライゼーション

AI音声生成ツールは、表現力を犠牲にすることなく、コンテンツを複数の言語に拡張するのに役立ちます。映画やテレビ番組の吹き替えから、eラーニング教材やオーディオブックを世界中で利用可能にするまで、ライセンスされたAI音声はローカライゼーションをより速く、より手頃な価格で、よりエンゲージメントの高いものにします。

クリエイティブメディアとストーリーテリング

アーティスト、教育者、クリエイターたちはパロディ、風刺、没入型ストーリーテリングのためにAI音声を実験しています。視聴者に合成音声であることが明確に伝えられている場合、AIは創造性に新たな層を加え、歴史的なナレーションを復活させ、キャラクターの声を実験したり、デジタルアートの境界を押し広げたりすることができます。

有名人の声生成ツールに代わる安全な選択肢

法的または倫理的リスクなしに音声AIのメリットを得たい場合、最も安全な選択肢は模倣ではなくアクセシビリティやコンテンツ作成のために設計されたツールを使用することです。

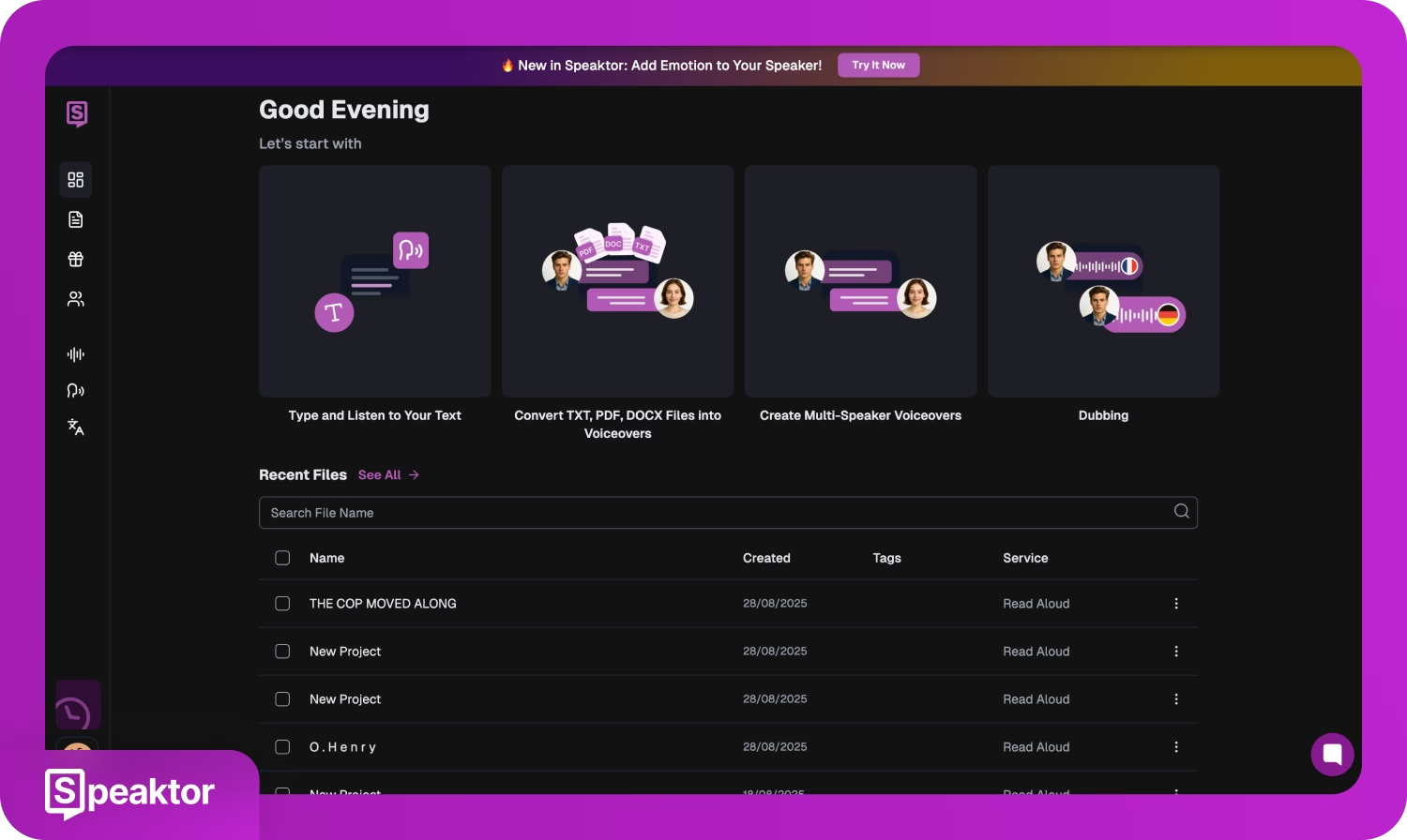

そのような選択肢の一つがSpeaktorです。実在の人物の声をクローンする代わりに、Speaktorは複数の言語にわたる自然な合成音声のライブラリを提供しています。これはAIボイスオーバー、オーディオブック、eラーニングモジュール、ポッドキャストの作成、そして読書が困難な人々のためのコンテンツのアクセシビリティ向上にも広く使用されています。

Speaktorの音声は有名人に紐づいていないため、誰かのアイデンティティ権を侵害するリスクなしに、AI音声技術の利点:スケーラビリティ、明瞭さ、多言語サポートを得ることができます。

SpeaktorがAIボイスオーバーアプリとして際立っている理由は以下の通りです:

- 50以上の言語と方言にわたる音声合成を可能にします

- リアルで表現力豊かなAI生成音声を提供します

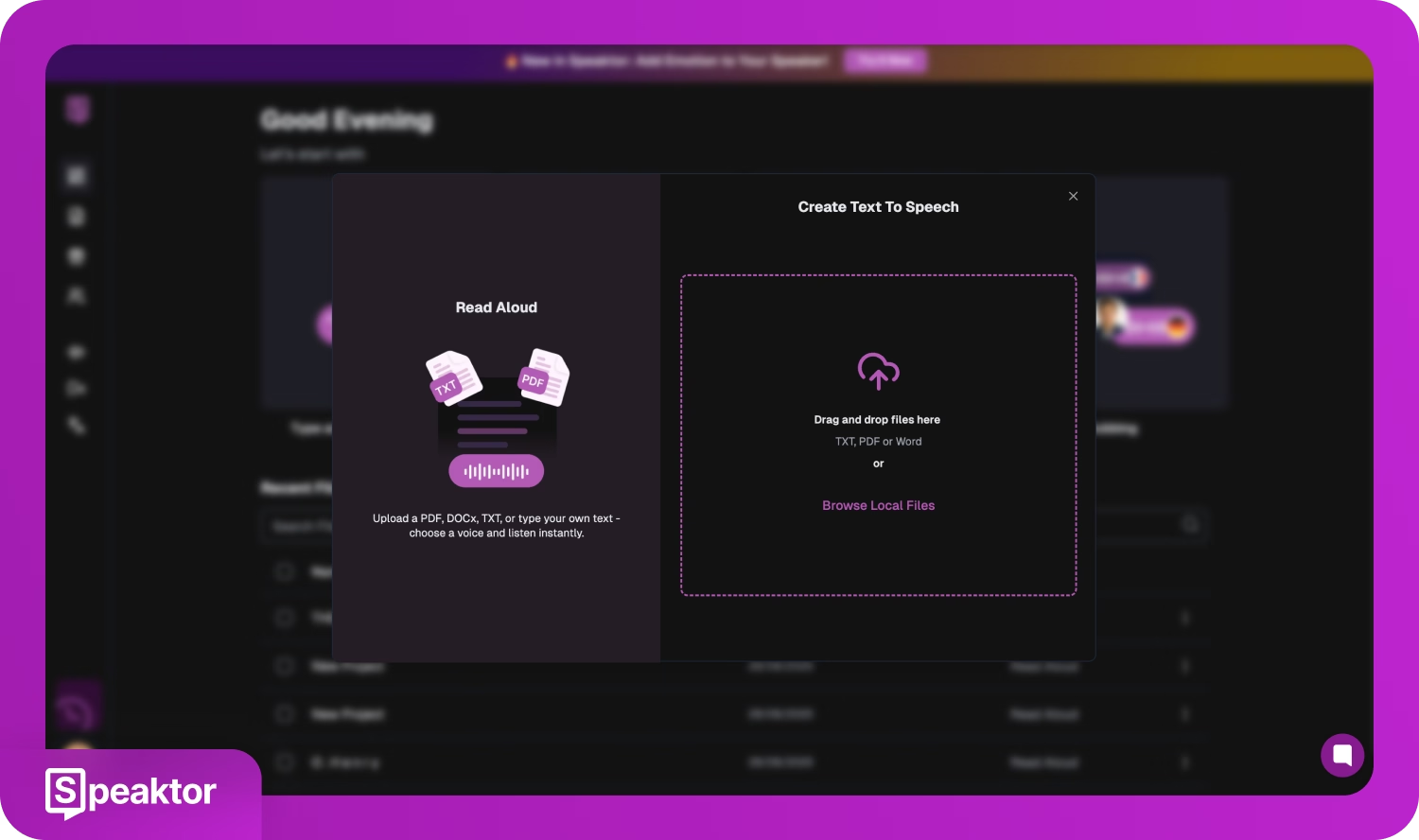

- テキストを貼り付けたり、PDF、TXT、DOCXフォーマットの文書をアップロードしたりできます

- トーン、スタイル、感情、ペースなど様々な音声と設定を提供し、異なる聴衆に合わせたオーディオのカスタマイズが可能です

- MP3またはWAVフォーマットでの簡単なオーディオエクスポートをサポートします

- 直感的なウェブダッシュボードとモバイルアプリを備え、デスクトップ、Android、iOSで利用可能です

音声AIツールで倫理的な道を進む

有名人の声生成ツールは確かに魅力的に感じますが、法的紛争、評判の損害、規制当局の取り締まりのリスクは、しばしばその目新しさを上回ります。

より安全な選択は、実在の人物を模倣するツールを避け、アクセシビリティ、創造性、コンテンツ制作のために設計されたAI音声生成ツールやテキスト読み上げソフトウェアに依存することです。

ここでSpeaktorのようなプラットフォームが役立ちます。言語を超えた自然な合成音声の幅広いラインナップを提供することで、Speaktorはクローニングに関連する倫理的または法的懸念なしにAI音声技術のメリットを提供します。

責任を持ってAI音声を活用したい場合は、今すぐSpeaktorでの実験を始めましょう!

よくあるご質問

いいえ、有名人の声を使用する明示的な書面による同意がない限り安全ではありません。同意なく有名人の声を使用すると、法的措置、ブランドの損害、さらには詐欺につながる可能性があります。単にテキストを高品質のナレーションに変換することが目的であれば、SpeaktorのようなリアリスティックなAI音声生成ツールは、有名人を模倣せずに安全な代替手段を提供します。

有名人の声生成ツールは特定の人物の声を模倣しますが、AI音声生成ツールは実在の人物に紐づかない合成音声を作成します。前者はプライバシーや著作権の問題を引き起こしますが、後者はプロのナレーション、オーディオブック、eラーニングのために設計されています。Speaktorのようなツールを使用すれば、法的境界を越えることなく、複数の言語で音声を生成できます。

はい。有名人の声生成ツールは人間の話し方のピッチ、トーン、言語的なニュアンスを捉えることができます。しかし、精度が高いことは許可を意味するわけではありません。これらのシステムは望ましい有名人の声を模倣できますが、より安全なアプローチは、クリエイティブなプロジェクトのために表現力豊かでありながら中立的なAI音声を生成するプラットフォームを使用することです。

はい。多くのプラットフォームは、ユーザーが機能をテストするのに役立つ無料のAI音声生成ツールオプションを提供しています。例えばSpeaktorでは、テキストを複数の言語で自然なAI音声出力に変換できるため、無許可の有名人のAI音声クローンに頼ることなく、トレーニングビデオ、ポッドキャスト、電子書籍、ソーシャルメディアコンテンツ用の音声録音を作成できます。無料でお試しいただけます!

はい。今日のリアルな音声技術により、有名人の声の印象を使わずにスタジオ品質のナレーションを実現することが可能です。例えば、SpeaktorのリアルなAI音声生成ツールは、声優に匹敵する表現力豊かで自然なオーディオファイルを提供します。

有名人の声生成ツールを使用すると短期的な注目を集めるかもしれませんが、企業は著作権紛争、規制上の罰金、評判の損害にさらされる可能性もあります。生成された声が実際の推薦と間違われると、ブランドは信頼を失うリスクがあります。そのため、企業はしばしばSpeaktorのようなAI音声生成ツールを選択します。これらは独自の有名人の声を模倣せずに、スケーラブルな音声品質を提供します。