Генератор голосів знаменитостей: ризики, регулювання та відповідальні альтернативи

Зміст

- Як працюють генератори голосів знаменитостей на базі ШІ?

- Які основні ризики генерації голосів знаменитостей?

- Галузеві правила щодо клонування голосів знаменитостей

- Як слід діяти з генераторами голосів знаменитостей?

- Які є відповідальні випадки використання голосового ШІ?

- Безпечніша альтернатива генератору голосів знаменитостей

- Оберіть етичний шлях з інструментами голосового ШІ

Transcribe, Translate & Summarize in Seconds

Зміст

- Як працюють генератори голосів знаменитостей на базі ШІ?

- Які основні ризики генерації голосів знаменитостей?

- Галузеві правила щодо клонування голосів знаменитостей

- Як слід діяти з генераторами голосів знаменитостей?

- Які є відповідальні випадки використання голосового ШІ?

- Безпечніша альтернатива генератору голосів знаменитостей

- Оберіть етичний шлях з інструментами голосового ШІ

Transcribe, Translate & Summarize in Seconds

TL;DR

Інструменти генератора голосів знаменитостей є творчими, але несуть серйозні ризики, такі як шахрайство, дезінформація, пошкодження бренду та юридичні спори

Регулятори по всьому світу швидко рухаються для захисту голосів як частини особистої ідентичності

Відповідальні випадки використання голосового ШІ включають доступність (відновлення втраченого мовлення), локалізацію (багатомовний контент) та творчі медіа (розповідь історій, освіта, пародія)

Безпечніший вибір — уникати клонування реальних людей і віддавати перевагу платформам, як-от Speaktor, яка надає природно звучні синтетичні голоси на понад 50 мовах без юридичних чи етичних ризиків

Генератори голосів знаменитостей набули вибухової популярності, дозволяючи будь-кому змусити поп-зірку озвучити подкаст або відомого актора розказати жарт у вашому груповому чаті.

На перший погляд, цей інструмент здається грайливим та інноваційним. Проте під поверхнею технологія піднімає складні питання щодо приватності, законності та етики.

Інструменти генератора голосів знаменитостей покладаються на передові моделі ШІ, які можуть імітувати тон, каденцію та особистість з моторошною точністю. Це відкриває двері для творчих випадків використання, як-от дублювання фільмів кількома мовами, створення більш захопливих аудіокниг або надання людям з втратою мови нових способів спілкування.

Але є й темніша сторона: клоновані голоси вже використовуються як зброя в шахрайствах, кампаніях дезінформації та неліцензійних рекламних кампаніях. Для знаменитостей це пряма загроза репутації та доходам. Для таких галузей, як медіа, розваги та банківська справа, це виклик для регулювання та довіри.

Як працюють генератори голосів знаменитостей на базі ШІ?

У своїй основі генератори голосів знаменитостей покладаються на синтез мовлення з використанням ШІ. Вони беруть реальні записи голосу людини і навчають нейронні мережі імітувати їх унікальні патерни.

Процес включає два ключові компоненти:

- Моделі клонування голосу: Моделі глибокого навчання аналізують голосові характеристики людини, такі як висота, тон, ритм та акцент. З достатньою кількістю зразків система створює цифровий голосовий відбиток, який відтворює сутність того, як ця людина говорить.

- Двигуни перетворення тексту в мовлення (TTS) або мовлення в мовлення: Коли модель вивчила голос, вона може генерувати нове аудіо. Ви можете ввести текст (TTS) або надати власний голосовий ввід (мовлення в мовлення), і ШІ відтворить його голосом клонованої знаменитості.

Сучасні системи можуть навіть вловлювати емоції та інтонації, щоб зробити результат більш автентичним, ніж роботизованим. Оскільки навчання та рендеринг часто відбуваються в хмарі, будь-хто з дружнім до користувача додатком може створити аудіо, схоже на голос знаменитості, за лічені хвилини.

Які основні ризики генерації голосів знаменитостей?

1. Шахрайство та кіберзлочини

У гучній справі 2024 року працівник багатонаціональної фірми був обманутий і перевів понад 25 мільйонів доларів через відеодзвінок з діпфейком, що містив клонований голос фінансового директора. Фальшиві екстрені дзвінки або клоновані голоси використовуються для обману жертв, щоб ті передали гроші або конфіденційну інформацію. Ці атаки важче виявити, ніж традиційний фішинг, оскільки вони звучать автентично.

2. Юридичні баталії

Голос людини вважається частиною її ідентичності. Використання його без згоди може порушувати право на публічність або схожість, що призводить до судових позовів. У таких галузях, як реклама, ігри чи кіно, неліцензійне використання голосу знаменитості може порушувати контракти та викликати дорогі юридичні суперечки.

3. Пошкодження бренду

Якщо клонований голос знаменитості, здається, рекламує продукт або висловлює думку, з якою вони ніколи не погоджувались, це може підірвати довіру як до знаменитості, так і до бренду. Для компаній асоціація з неліцензійним клонуванням голосу може розглядатися як неетична і шкодити лояльності клієнтів.

4. Дезінформація

Аудіо діпфейки полегшують поширення неправдивої інформації або маніпулювання громадською думкою. Переконливий фальшивий новинний кліп або політична заява відомим голосом можуть бути особливо шкідливими, оскільки люди схильні вірити тому, що чують.

5. Ризики безпеки

Між 2024 і 2025 роками шахрайства з використанням ШІ-імітацій тривожно зросли на 148%. Системи голосової аутентифікації, широко використовувані в банківській справі та службах підтримки клієнтів, тепер стали вразливими цілями. За допомогою клонованого голосу зловмисники можуть обійти перевірки особи та отримати доступ до конфіденційних облікових записів.

Галузеві правила щодо клонування голосів знаменитостей

Сполучені Штати

- Закон ELVIS у Теннессі (2024): Перший закон США, який явно захищає голоси виконавців від зловживання ШІ. Він визначає несанкціоноване клонування як кримінальний злочин і був просунутий за активної підтримки музичних лейблів та спілок артистів.

- Закон NO FAKES (буде повторно представлений у 2025): Двопартійний федеральний законопроєкт, який заборонить несанкціоновані ШІ-копії голосу чи зовнішності особи. Він включає винятки для пародій та журналістики, але запроваджує процес видалення контенту для жертв, щоб повернути контроль над своєю особистістю.

- Закон TAKE IT DOWN (2025): Хоча він зосереджений переважно на некосенсуальних інтимних зображеннях, закон TAKE IT DOWN свідчить про те, що регулювання діпфейків тепер твердо стоїть на порядку денному Вашингтона, закладаючи основу для ширшого захисту.

Європа

- Закон ЄС про ШІ (чинний з 2024): Перший у світі комплексний закон про ШІ. Він класифікує технології діпфейків (включаючи клонування голосу) як «високоризикові», коли вони використовуються обманним шляхом, вимагаючи чіткого розкриття інформації та суворішого дотримання вимог.

- Запропонований закон Данії (2025/26): Новаторська поправка до закону про авторське право, яка надала б людям явні права власності на їхній голос, обличчя та зовнішність. Жертви несанкціонованого клонування могли б вимагати видалення контенту та компенсацію. Запропонований закон міг би стати моделлю для інших держав ЄС.

Окрім США та Європи, інші країни також швидко вживають заходів для вирішення ризиків, пов'язаних із клонуванням голосів знаменитостей або клонуванням голосу загалом.

Від Азії до Латинської Америки, політики досліджують нові правила, які врівноважують інновації із захистом від крадіжки особистості та дезінформації.

Підходи різняться, але глобальна тенденція очевидна: галузеві регулятори розглядають клонування голосу як питання з високими ставками, яке вимагає правової ясності та гарантій для окремих осіб.

Як слід діяти з генераторами голосів знаменитостей?

- Отримайте явну згоду: Якщо ви маєте намір використовувати голос реальної людини, отримайте письмовий дозвіл від неї або її представників. Це найчіткіша гарантія від юридичних чи репутаційних наслідків.

- Будьте прозорими з аудиторією: Завжди розкривайте, коли голос створений за допомогою ШІ. Просте застереження будує довіру та допомагає уникнути сприйняття обману.

- Тримайтеся подалі від зон високого ризику: Політичні повідомлення, медичні поради, фінансові інструкції та комерційні рекламні кампанії особливо небезпечні без ліцензій.

- Обирайте платформи, що відповідають вимогам: Покладайтеся на інструменти, які пропонують водяні знаки, журнали використання та функції видалення, демонструючи, що вони серйозно ставляться до зловживань.

Клонування голосів знаменитостей може бути пов'язане з ризиками, але сама технологія голосового ШІ має змістовні та етичні застосування.

Які є відповідальні випадки використання голосового ШІ?

Доступність

Голосовий ШІ дає людям, які втратили природну мову, спосіб знову спілкуватися. Навчаючи моделі на попередніх записах, люди можуть зберегти або навіть відновити власні голоси. Для інших природно звучні голоси ШІ роблять програми зчитування з екрану, допоміжні пристрої та повсякденні цифрові взаємодії більш інклюзивними.

Чи знаєте ви:

Після операції на мозку 21-річна Лексі Боган втратила здатність говорити. Використовуючи 15-секундне відео, дослідники співпрацювали з OpenAI, щоб відтворити її підлітковий голос, який вона тепер використовує через додаток для спілкування та виконання повсякденних завдань.

Локалізація

Генератори голосу на базі ШІ можуть допомогти масштабувати контент різними мовами, не жертвуючи виразністю. Від дубляжу фільмів і телешоу до створення матеріалів для електронного навчання чи аудіокниг для глобальної аудиторії, ліцензовані голоси ШІ роблять локалізацію швидшою, доступнішою та більш привабливою.

Креативні медіа та сторітелінг

Митці, освітяни та творці експериментують з голосами ШІ для пародій, сатири та створення захоплюючих історій. Коли аудиторія чітко поінформована про те, що голоси синтетичні, ШІ може додати нові шари креативності, відродити історичні розповіді, експериментувати з голосами персонажів або розширювати межі цифрового мистецтва.

Безпечніша альтернатива генератору голосів знаменитостей

Якщо ви хочете отримати переваги голосового ШІ без юридичних чи етичних ризиків, найбезпечніший варіант — використовувати інструменти, розроблені для доступності та створення контенту, а не для імітації.

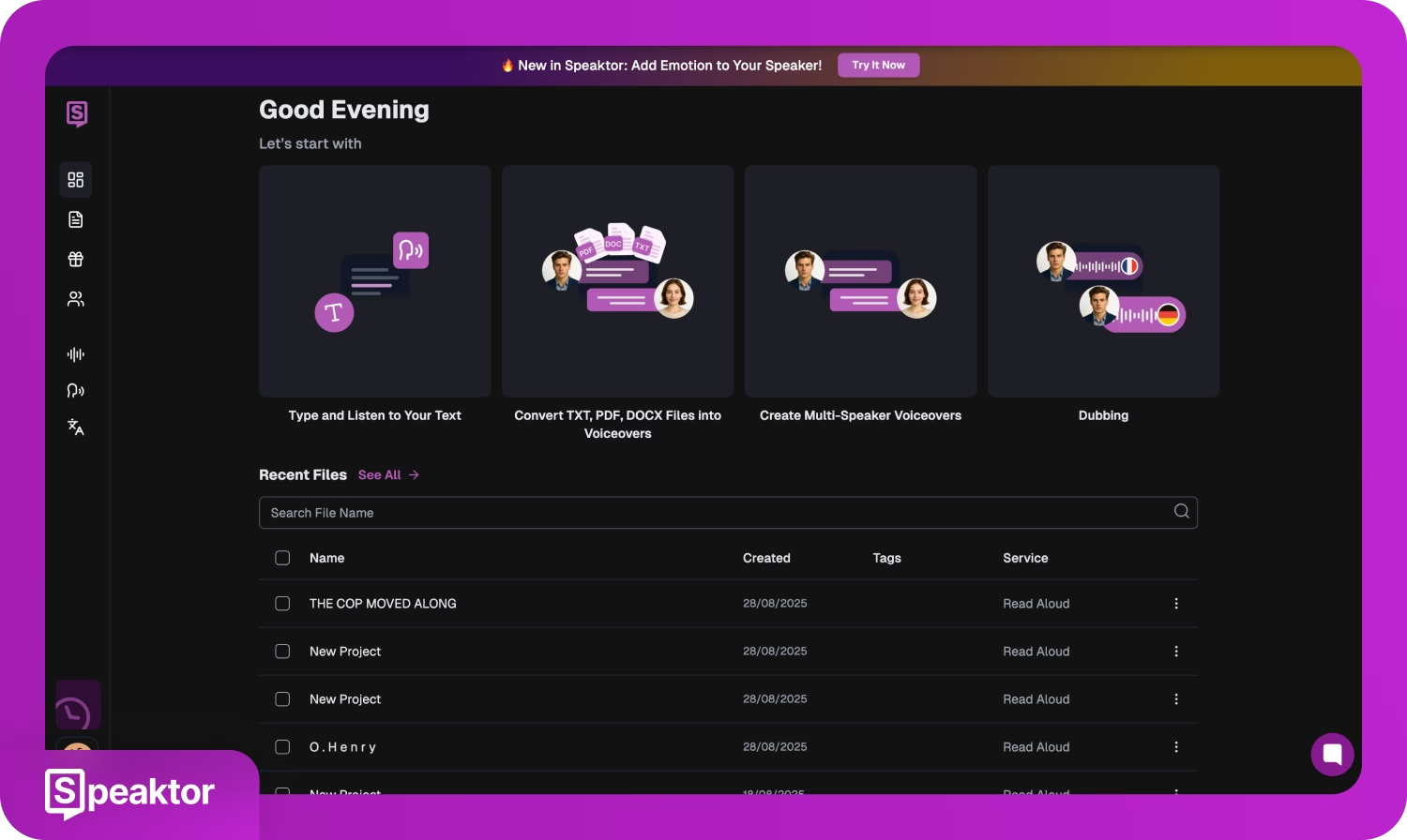

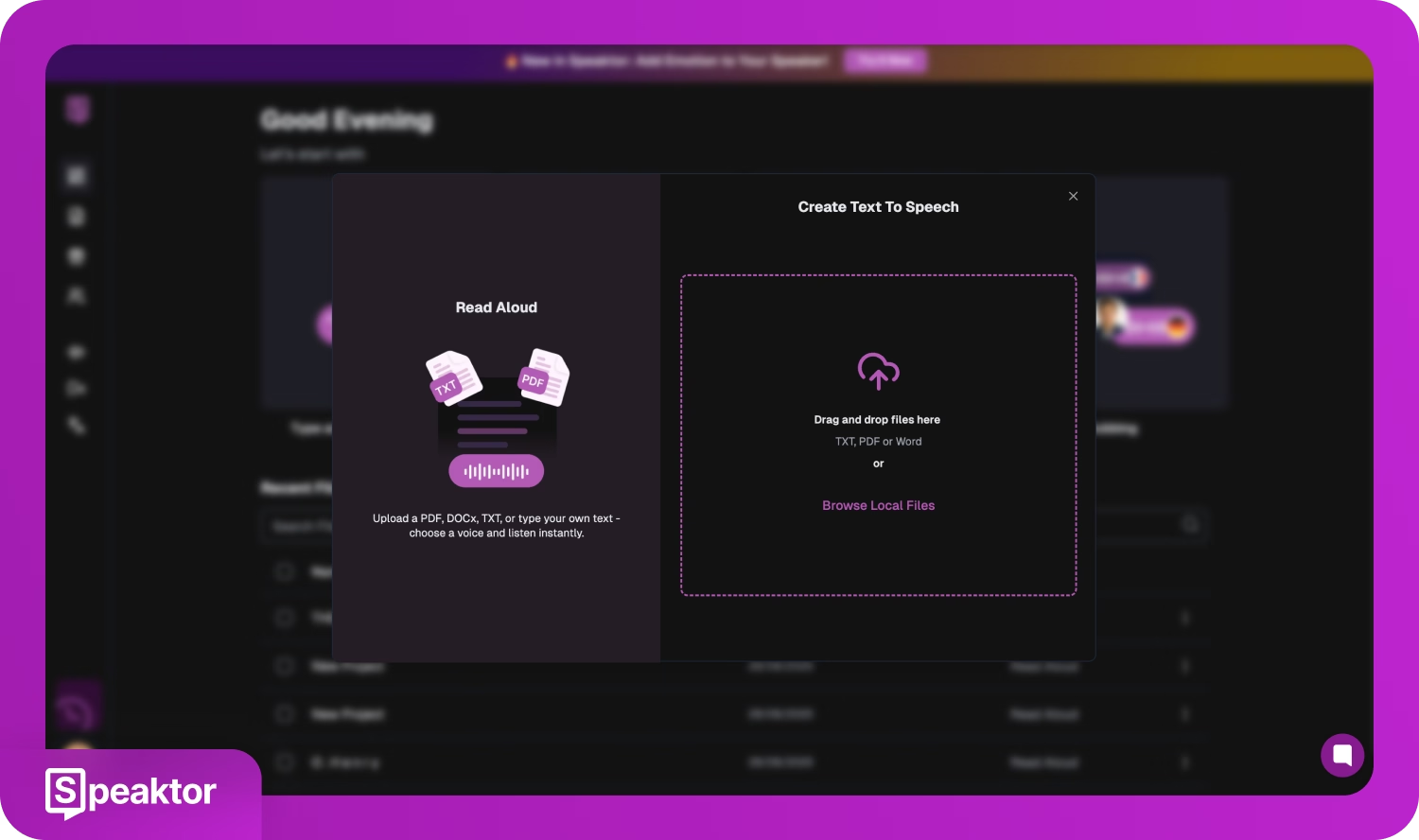

Одним із таких варіантів є Speaktor. Замість клонування реальних людей, Speaktor пропонує бібліотеку природних синтетичних голосів різними мовами. Він широко використовується для створення озвучки ШІ, аудіокниг, модулів електронного навчання, подкастів, а також для забезпечення доступності контенту для людей з труднощами читання.

Оскільки голоси Speaktor не пов'язані зі знаменитостями, ви отримуєте переваги технології голосового ШІ: масштабованість, чіткість і багатомовну підтримку без ризику порушення чиїхось прав на особистість.

Ось чому Speaktor виділяється як додаток для озвучування ШІ:

- Забезпечує синтез голосу понад 50 мовами та діалектами

- Забезпечує реалістичне та виразне мовлення, згенероване ШІ

- Дозволяє вставляти текст або завантажувати документи у форматах PDF, TXT або DOCX

- Пропонує широкий спектр голосів і налаштувань, таких як тон, стиль, емоції та темп, що дозволяє адаптувати аудіо для різної аудиторії

- Підтримує простий експорт аудіо у форматах MP3 або WAV

- Має інтуїтивно зрозумілу веб-панель і мобільний додаток; доступний на настільних комп'ютерах, Android та iOS

Оберіть етичний шлях з інструментами голосового ШІ

Генератор голосів знаменитостей, безумовно, здається захоплюючим, але ризики юридичних суперечок, репутаційної шкоди та регуляторних обмежень часто переважають новизну.

Безпечніший вибір — уникати інструментів, які імітують реальних людей, і покладатися на інструменти генерації голосу ШІ або програмне забезпечення перетворення тексту на мовлення, розроблені для доступності, творчості та виробництва контенту.

Саме тут на допомогу приходять платформи на зразок Speaktor. Пропонуючи широкий спектр природних синтетичних голосів різними мовами, Speaktor надає вам переваги технології голосового ШІ без етичних чи юридичних проблем, пов'язаних із клонуванням.

Якщо ви хочете відповідально використовувати голоси ШІ, почніть експериментувати зі Speaktor вже сьогодні!

Поширені запитання

Ні, якщо у вас немає письмової згоди на використання голосу знаменитості. Використання голосів знаменитостей без згоди може призвести до судових позовів, пошкодження бренду та навіть шахрайства. Якщо ваша мета - просто перетворити текст у високоякісну озвучку, реалістичний ШІ-генератор голосу, як Speaktor, пропонує безпечнішу альтернативу без імітації голосів публічних осіб.

Зміна голосу знаменитості імітує конкретну особу, тоді як ШІ-генератор голосу створює синтетичні голоси, не пов'язані з реальними особами. Перше викликає занепокоєння щодо конфіденційності та авторських прав, тоді як друге призначене для професійного озвучування, аудіокниг чи електронного навчання. За допомогою інструментів, як Speaktor, ви можете створювати аудіо кількома мовами, не порушуючи юридичних меж.

Так. ШІ-генератор голосів знаменитостей може вловлювати висоту, тон та лінгвістичні нюанси людських мовних патернів. Однак точність не означає дозвіл. Ці системи можуть імітувати бажаний голос знаменитості, але безпечнішим підходом є використання платформ, які створюють виразні, але нейтральні ШІ-голоси для творчих проєктів.

Так. Багато платформ надають опцію безкоштовного ШІ-генератора голосу, щоб допомогти користувачам протестувати функції. Speaktor, наприклад, дозволяє перетворювати текст у природний ШІ-голосовий вивід різними мовами, щоб ви могли створювати голосові записи для навчальних відео, подкастів, електронних книг або контенту для соціальних мереж без використання неавторизованих клонів голосів знаменитостей. Ви можете спробувати це безкоштовно!

Так. Сучасні реалістичні голосові технології дозволяють досягти студійної якості озвучення без імітації голосів знаменитостей. Наприклад, реалістичний ШІ-генератор голосів Speaktor забезпечує виразні, природні аудіофайли, які не поступаються голосовим акторам.

Використання генератора голосів знаменитостей на базі ШІ може привернути короткострокову увагу, але також наражає компанії на суперечки щодо авторських прав, регуляторні штрафи та репутаційну шкоду. Бренди ризикують втратити довіру, якщо згенерований голос сприймається як реальна підтримка. Ось чому підприємства часто обирають ШІ-генератори голосу, як Speaktor, які забезпечують масштабовану якість голосу без імітації унікальних голосів знаменитостей.