ボイスクローン技術は最近、報道のかなりのシェアを受けていますが、それは時に最高の理由によるものです。 著名なアーティストや著名人が、そのような技術を使用してなりすましをしたとして、個人や組織を訴えています。

このガイドでは、音声クローンソフトウェアの使用のダークサイドについて、それに伴うリスクや倫理的な懸念など、探っていきます。 また、次のような代替手段も提供しています Speaktor、ニーズに合わせて使用できます。

AI音声クローンはどのように機能し、なぜ危険なのですか

VoiceOver用のパーソナライズされた音声クローンは、人工知能(AI)を使用して、人の声の合成バージョンを識別して複製します。

人々は、声がなりすましをしている人のものであるかのように見せるために、これらのクローンを異なる方法で使用します。 彼らはその人のユニークな声の特徴を再現します。

Scarlett Johannesen氏のOpen AIに対する訴訟 をめぐる論争を考えてみてください。 彼女は、彼らが音声ベースのチャットボットに対してHER同意なしにHER声を模倣したと主張しました。

TTS with Voice Cloning で Deepfake ボイスを作成する方法

ディープフェイクの脅威は数年前から高まっています。 これは、彼らには多くの危険が伴うためです。 これには、選挙操作、詐欺、有名人のポルノ、偽情報攻撃、ソーシャルエンジニアリングなど、あらゆるものが含まれます。

操作されたコンテンツや合成されたコンテンツに遭遇した WHO は、見たり聞いたりしたことを信じることがよくあります。 これは、音声クローンが個人の声を正確に複製するように設計されているため、多くの場合、有害な結果をもたらすためです。

したがって、テキスト読み上げは、そのようなテクノロジーの倫理的な使用を気にしない人々の手に渡ると WHO かなり暗い側面を持っています。 また、音声クローニング機能を使用する際に悪意を持っている可能性もあります。

前述したように、 AI ボイスクローンジェネレーターは様々な方法で武器化することができます。 人々はこれらの音声モデルを使用して、個人に影響を与えたり、人口の大部分を操作したりします。

ガーディアン紙の報道によると、Deepfakeポルノの被害者になったWHO約4000人の中に 、250人以上の英国の有名人 が含まれているとのことです。 このようなポルノを作る上で重要な側面は、ボイスクローニング技術の使用です。 それは、単なる身体的外観を超えて、個人の声を偽装します。

これらの例は、人々が聞いたり見たりしたことを額面通りに受け取ることが多いため、個人の評判を著しく損なう可能性があります。

音声クローニングの最大の脅威であるプライバシーまたはセキュリティは何ですか

この時点でお気づきかもしれませんが、音声クローニングの使用には、プライバシーやセキュリティに関する大きな脅威が伴います。 同意なしに声を使用することにより、人のプライバシーを侵害する可能性があります。 しかし、組織レベルでは損害を与える可能性もあります。 詐欺師は、このような手口を使って、無防備な経営者に便乗して、重要な財務データや個人データを引き出します。

クローン音声によるソーシャルエンジニアリング攻撃

このような詐欺は大規模に発生する可能性がありますが、毎日あなたの周りで見つけることもできます。 あなたは、あなたが知っている誰かがあなたに電話をかけてきて、彼らが逮捕され、保釈金が必要だと言ったことを思い出すことができるかもしれません。 彼らは、音声録音を使用して、人の元の声を再現することもできました。 そのような例が思い浮かびますか?

このようなソーシャルエンジニアリング詐欺は、あなたやあなたの愛する人に影響を与える可能性があります。 十分な法的救済策がないことを考えると、個人は常に警戒する必要があります。 これらの詐欺は、ディープフェイクが本物のように聞こえることが多いため、特に危険です。

たとえば、詐欺師があなたの愛する人の話し方を知っている場合、自然人と彼らの深い偽の声を区別するのに助けが必要になります。

なぜ Speaktor が音声クローニングのより良い代替手段なのか

この時点で、音声クローニングの危険性はほぼ明らかです。 非倫理的または悪意を持って使用すると、有害な結果をもたらす可能性があります。 これは、SpeaktorのようなAIボイスジェネレーターが、他のAI駆動の音声クローン作成ツールとは一線を画す点です。

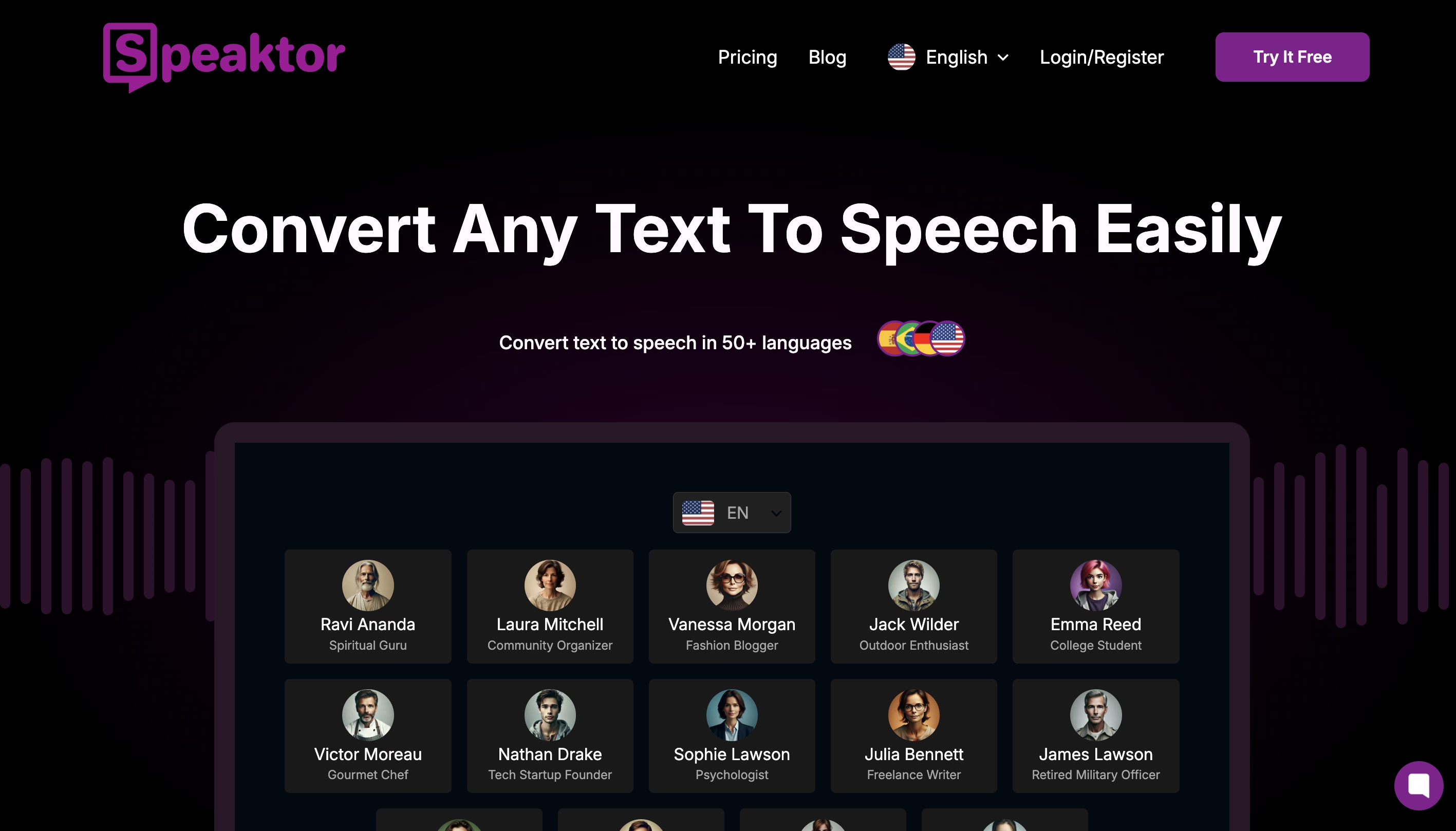

Speaktor は、音声合成を使用し、書かれたコンテンツを高品質の話し言葉に変換する AI駆動のテキスト読み上げツールです。 Speaktor は、生きている人のふりをすることなく、音声データを倫理的に使用します。 コンテンツクリエーターとマーケターの両方が AI生成した音声を作成するのに最適です。

安全でリアルなノンクローンボイス

自然な響きの AI 声により、 Speaktor は音声クローニングなどのテクノロジーに依存しずに高品質の出力を生成します。 これにより、音声クローン作成のリスクが完全に排除され、倫理的またはプライバシー関連の懸念が解消されます。

Speaktor は、さまざまな目的でテキスト読み上げ技術を使用し、プライバシーとセキュリティを確保しています。

Speaktorを使用して、マーケティングチャネル全体でVoiceOver、プレゼンテーション、またはデジタル アクセシビリティ を向上させることができます。

ボイスクローニングの倫理的懸念とは

音声クローニング技術には、メディアで増幅されるいくつかの倫理的およびプライバシー関連の問題が伴います。

メディアにおけるパーソナライズされた音声クローンの問題

メディアは、大量に普及することの利点を提供します。 したがって、音声クローニング技術の誤用は、個人情報の盗難につながる可能性があります。 さらに重要なことに、それは名誉毀損につながり、個人や組織に対する公衆の信頼を損なうことさえあります。 これは、問題の多い時期や選挙の際に武器化された場合に起こり得ます。

名誉毀損や個人情報の盗難の問題に加えて、その他の重要な懸念事項には次のようなものがあります。

- 同意と所有権: 音声クローニング技術の倫理的な使用には、音声が複製される個人の許可が必要です これはしばしば起こりませんが、個人の自律性を確保することが重要です。

- 濫用: 音声クローニング技術は、ソーシャルエンジニアリング、フィッシング詐欺、誤情報や偽情報キャンペーンの流布、選挙運動や投票パターンの操作など、さまざまな用途に悪用される可能性があります。

- 個人のプライバシーの保護: 個人の声を使用する際の同意の欠如は、個人のプライバシーを侵害する可能性があります したがって、人の声の不正使用を防ぐことが最も重要になります。

ボイスクローニング詐欺から身を守るには?

個人は、音声クローン詐欺から身を守るために、一定の措置を講じる必要があります。 これは、前述のように法的措置を取ることのリスクと困難さを考えると、特に当てはまります。

クローン音声詐欺に陥らないようにするための実用的なヒント

ボイスクローニング詐欺の被害に遭わないようにしたいのであれば、いくつかの実用的なヒントがあります。 その中には、以下のようなものがあります。

- 機密性の高いアカウントや金融口座に多要素認証を使用することで、悪意のある人物があなたの個人データや財務データにアクセスするリスクを最小限に抑えることができます。

- 不審 WHO 感じられるような電話をかけてきた人には関わらないでください 誰かがそれを利用してあなたからお金を搾取しようとしても、慌てることを避けてください。

- 詐欺に遭わないようにするには、信頼できる媒体やツールを使用して発信者の身元を確認してみてください。

- あなたの声は詐欺や詐欺に使われる可能性があるため、不明または信頼性の低い音声クローン作成ツールの使用は避けるべきです。

- Speaktorのように、音声を使用する必要がない安全なサービスを選択してください 純粋に AI を使用してカスタマイズされた音声を生成します 信頼性の高い テキスト読み上げChrome拡張機能 の使用を検討してください。

結論

その利点にもかかわらず、 AIを搭載した音声クローンは常に誤用されるリスクを伴います。

さらに、ディープフェイクの台頭とサイバー犯罪の増加により、ユーザーはより安全な代替手段に頼ることが重要になっています。 これらは、個人のプライバシーを侵害したり、同意なしになりすましたりすることなく、高度な AI を使用する必要があります。

Speaktor は、クローンされていない高品質のオーディオ ファイル用の TTS 音声を提供します。 これらの音声を使用して、コンテンツ作成とマーケティングのすべてのニーズに対応する音声を生成できます。 これは、従来の音声クローニング技術に代わる倫理的で信頼性の高い代替手段です。

Dubai, UAE

Dubai, UAE