Технология клонирования голоса в последнее время получила изрядную долю внимания в прессе, иногда только по самым лучшим причинам. Известные художники и личности подали в суд на отдельных лиц и организации за использование такой технологии для того, чтобы выдать себя за них.

В этом руководстве рассматривается темная сторона использования программного обеспечения для клонирования голоса, в том числе связанные с этим риски и этические проблемы. Он также предлагает альтернативы, такие как Speaktor, которые вы можете использовать для своих нужд.

Как работает клонирование голоса AI и почему это рискованно

Персонализированные клоны голоса для VoiceOver используют искусственный интеллект (AI) для идентификации и воспроизведения синтетической версии голоса человека.

Люди используют эти клоны по-разному, чтобы создать впечатление, что голос принадлежит человеку, за которого они себя изображают. Они воспроизводят уникальные вокальные данные человека.

Подумайте о спорах вокруг иска Скарлетт Йоханнесен против Open AI . Она утверждала HER что они имитировали голос без HER согласия для своего голосового чат-бота.

Как TTS с клонированием голоса создает голоса Deepfake

Угроза дипфейков растет уже несколько лет. Это связано с тем, что они сопряжены со многими опасностями. К ним относятся все: от манипуляций на выборах, мошенничества, порнографии со знаменитостями, дезинформационных атак и социальной инженерии, а также некоторых других.

Те WHO сталкиваются с манипулируемым или синтетическим контентом, часто верят тому, что видят или слышат. Это связано с тем, что клонирование голоса предназначено для точного воспроизведения голоса человека, что часто приводит к разрушительным последствиям.

Таким образом, преобразование текста в речь имеет довольно темную сторону, когда оно находится в руках тех WHO не заботится об этичном использовании такой технологии. Они также могут иметь злой умысел при использовании функции клонирования голоса.

Как упоминалось выше, генератор AI клонирования голоса может быть использован в качестве оружия различными способами. Люди используют эти голосовые модели для воздействия на человека или даже для манипулирования большими слоями населения.

В сообщении в Guardian говорится, что более 250 британских знаменитостей входят в число около 4000 человек WHO стали жертвами Deepfake порнографии. Ключевым аспектом создания такой порнографии является использование технологии клонирования голоса. Он олицетворяет голос человека, выходящий за рамки его простой физической внешности.

Эти случаи могут серьезно повредить репутации человека, поскольку люди часто принимают то, что слышат или видят, за чистую монету.

Каковы самые большие угрозы конфиденциальности или безопасности при клонировании голоса

Как вы, вероятно, уже поняли, использование клонирования голоса несет с собой огромные угрозы конфиденциальности или безопасности. Он может нарушить неприкосновенность частной жизни человека, используя его голос без его согласия. Тем не менее, это также может нанести ущерб на организационном уровне. Мошенники часто используют такие уловки, чтобы обмануть ничего не подозревающего руководителя для извлечения критически важных финансовых или личных данных.

Атаки социальной инженерии с использованием клонированных голосов

Хотя такие мошенничества могут происходить в более широких масштабах, вы также можете сталкиваться с ними ежедневно. Возможно, вы можете вспомнить, как кто-то из ваших знакомых позвонил вам и сказал, что его арестовали и ему нужны деньги для залога. Они могли использовать голосовые записи, чтобы воспроизвести оригинальный голос человека. Приходят ли на ум такие случаи?

Такое мошенничество с использованием социальной инженерии может затронуть вас или ваших близких. Учитывая отсутствие достаточных средств правовой защиты, люди всегда должны проявлять бдительность. Эти мошенничества особенно опасны, потому что дипфейки часто звучат как настоящие подделки.

Например, если мошенник знает, как говорит ваш близкий человек, вам понадобится помощь, чтобы отличить физическое лицо от его голоса.

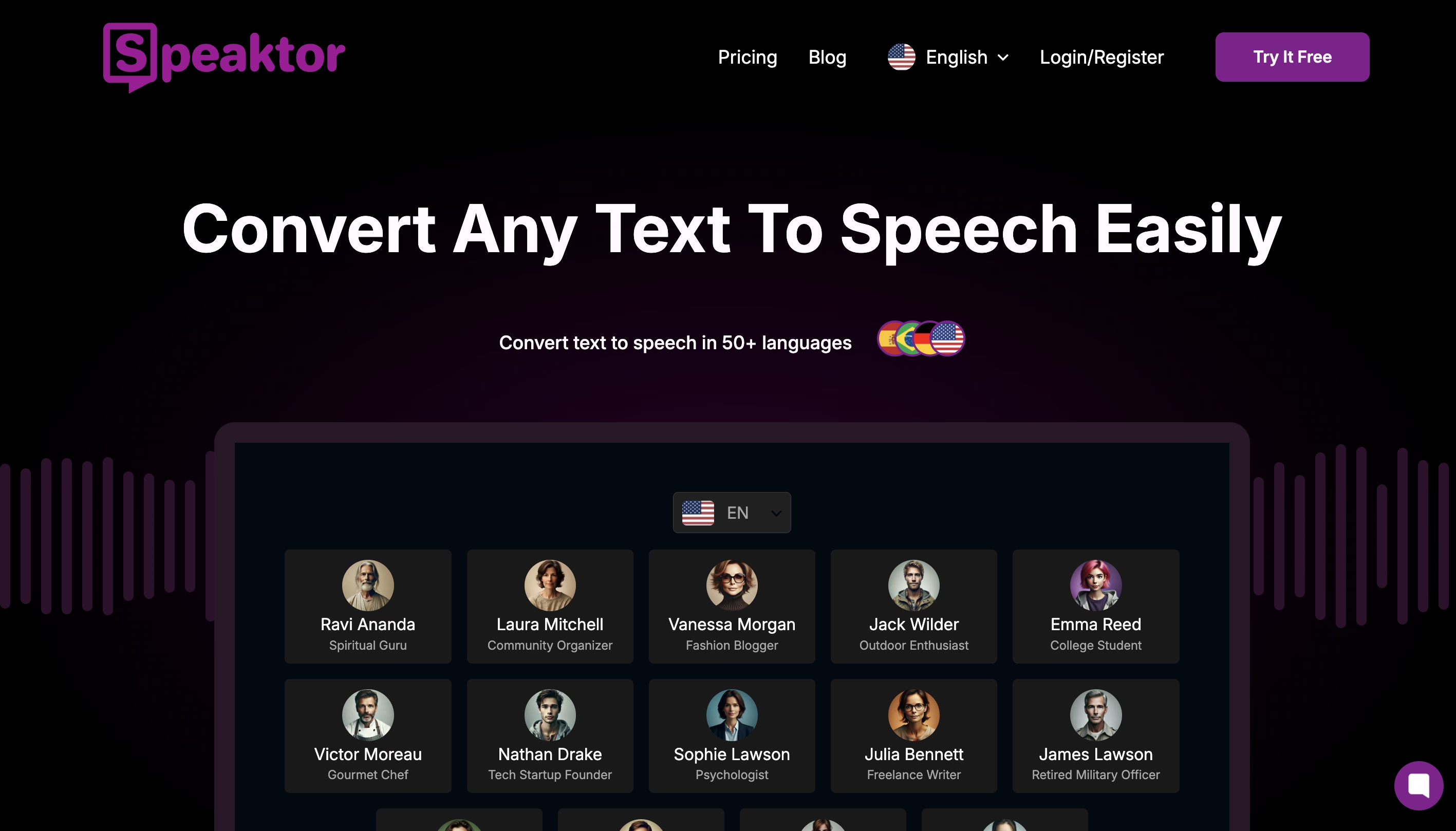

Почему Speaktor является лучшей альтернативой клонированию голоса

На данный момент опасность клонирования голоса практически очевидна. Он может иметь разрушительные последствия при неэтичном или злонамеренном использовании. Именно в этом AI генератор голоса, такой как Speaktor , отличается от других инструментов клонирования голоса на базе AI.

Speaktor — это AIинструмент для преобразования текста в речь, который использует синтез речи и преобразует письменный контент в высококачественные устные слова. Speaktor использует голосовые данные этично, не выдавая себя за живого человека. Он идеально подходит как для создателей контента, так и для маркетологов для создания AIголосов.

Безопасные и реалистичные голоса, не являющиеся клонами

Благодаря естественному звучанию AI голосов Speaktor не полагается на такие технологии, как клонирование голоса, для получения высококачественных результатов. Это полностью исключает риск клонирования голоса и устраняет любые этические проблемы или проблемы, связанные с конфиденциальностью, которые могут у вас возникнуть.

Speaktor использует технологию преобразования текста в речь для различных целей и обеспечивает конфиденциальность и безопасность.

Вы можете использовать Speaktor для создания VoiceOver, презентации или повышения цифровой доступности по всем маркетинговым каналам.

Каковы этические проблемы клонирования голоса

Технология клонирования голоса несет с собой ряд этических проблем и проблем, связанных с конфиденциальностью, которые усиливаются в средствах массовой информации.

Проблема персонализированных голосовых клонов в СМИ

Средства массовой информации предлагают преимущества массового распространения. Таким образом, неправомерное использование технологии клонирования голоса может привести к краже личных данных. Что еще более важно, это может привести к диффамации и даже подорвать общественное доверие к отдельным лицам или организациям. Это может произойти, если его использовать в качестве оружия во время смутных времен или выборов.

Помимо проблем диффамации и кражи личных данных, некоторые из других критических областей, вызывающих обеспокоенность, включают:

- Согласие и владение: Этичное использование технологии клонирования голоса требует разрешения человека, чей голос воспроизводится Часто этого не происходит, но крайне важно обеспечить личную автономию человека.

- Злоупотребление: Технология клонирования голоса может быть неправомерно использована для социальной инженерии, фишинговых афер, распространения ложной информации и дезинформационных кампаний, манипулирования предвыборной агитацией и моделями голосования и многого другого.

- Сохранение неприкосновенности частной жизни: Отсутствие согласия при использовании голоса человека может нарушить его конфиденциальность Таким образом, предотвращение несанкционированного использования голоса человека приобретает первостепенное значение.

Как вы можете защитить себя от мошенничества с клонированием голоса?

Физические лица должны предпринять определенные шаги, чтобы защитить себя от мошенничества с клонированием голоса. Это особенно верно, учитывая риски и сложность обращения в суд, о которых говорилось выше.

Практические советы, как не поддаться на мошенничество с клонированной голосовой связью

Если вы хотите быть уверены, что никогда не станете жертвой мошенничества с клонированием голоса, есть несколько практических советов, которым вы можете следовать. Некоторые из них включают в себя:

- Используйте многофакторную проверку подлинности для конфиденциальных или финансовых учетных записей, чтобы свести к минимуму риск доступа злоумышленников к вашим личным и финансовым данным.

- Не взаимодействуйте со звонящими WHO подозревайте себя подозрительными Избегайте паники, если кто-то попытается использовать его для вымогательства у вас денег.

- Чтобы убедиться, что вас не обманули, попытайтесь подтвердить личность звонящего с помощью надежного средства или инструмента.

- Поскольку ваш голос может быть использован для совершения мошенничества или мошенничества, вам следует избегать использования неизвестных или ненадежных инструментов клонирования голоса.

- Выбирайте безопасные сервисы, такие как Speaktor , которые не требуют использования голоса Он генерирует настраиваемые голоса исключительно с помощью AI Рассмотрите возможность использования надежного расширения Chrome для преобразования текста в речь .

Заключение

Несмотря на свои преимущества, клонирование голоса на основе AIвсегда сопряжено с риском неправомерного использования.

Кроме того, рост дипфейков и рост киберпреступности делают крайне важным, чтобы пользователи полагались на более безопасные альтернативы. Они должны использовать расширенные AI не нарушая неприкосновенность частной жизни человека и не выдавая себя за него без его согласия.

Speaktor предлагает неклонированные, высококачественные голоса TTS для аудиофайлов. Вы можете использовать эти голоса для создания речи для всех ваших потребностей в создании контента и маркетинге. Это этичная и надежная альтернатива традиционным технологиям клонирования голоса.

Dubai, UAE

Dubai, UAE