Technologie hlasových klonů se v poslední době dočkala značného množství tisku, někdy jen z těch nejlepších důvodů. Významní umělci a osobnosti žalovali jednotlivce a organizace za používání takové technologie k jejich vydávání se za ně.

Tato příručka zkoumá odvrácenou stranu používání softwaru pro klonování hlasu, včetně rizik a etických otázek s tím spojených. Nabízí také alternativy, jako např Speaktor, které můžete použít pro své potřeby.

Jak klonování hlasu AI funguje a proč je riskantní

Personalizované hlasové klony pro VoiceOver využívají umělou inteligenci (AI) k identifikaci a replikaci syntetické verze lidského hlasu.

Lidé používají tyto klony různě, aby to vypadalo, že hlas patří osobě, za kterou se vydáváte. Replikují jedinečné hlasové charakteristiky člověka.

Vzpomeňte si na kontroverzi kolem žaloby Scarlett Johannesenové proti Open AI . Tvrdila, že napodobovali HER hlas bez HER souhlasu pro svého hlasového chatbota.

Jak TTS s klonováním hlasu vytváří Deepfake hlasy

Hrozba deepfakes roste již několik let. Je to proto, že přicházejí s mnoha nebezpečími. Patří mezi ně mimo jiné vše od manipulace s volbami, podvodů, pornografie celebrit, dezinformačních útoků a sociálního inženýrství.

Ti WHO se setkají s manipulovaným nebo syntetickým obsahem, často věří tomu, co vidí nebo slyší. Je to proto, že klonování hlasu je navrženo tak, aby přesně replikovalo hlas jednotlivce, což má často škodlivé následky.

Převod textu na řeč má tedy svou stinnou stránku, pokud je v rukou těch WHO se nestarají o etické využití takové technologie. Mohou mít také nekalé úmysly při používání funkce klonování hlasu.

Jak již bylo zmíněno výše, generátor AI hlasových klonů lze využít jako zbraň mnoha způsoby. Lidé používají tyto hlasové modely k ovlivnění jednotlivce nebo dokonce k manipulaci s velkou částí populace.

Zpráva v Guardianu uvedla, že mezi zhruba 4000 lidmiWHO se stali oběťmi Deepfake pornografie, je více než 250 britských celebrit . Klíčovým aspektem výroby takové pornografie je použití technologie klonování hlasu. Zosobňuje hlas jednotlivce za jeho pouhým fyzickým vzhledem.

Tyto případy mohou vážně poškodit pověst jednotlivce, protože lidé často berou to, co slyší nebo vidí, za bernou minci.

Jaké jsou největší hrozby klonování hlasu pro soukromí nebo bezpečnost

Jak jste pravděpodobně v tomto bodě shromáždili, používání klonování hlasu s sebou přináší obrovské hrozby pro soukromí nebo bezpečnost. Může narušit soukromí osoby použitím jejího hlasu bez jejího souhlasu. Může to však být škodlivé i na organizační úrovni. Podvodníci často používají takové triky, aby se přiživili na nic netušícím vedoucím pracovníkovi a získali z něj důležité finanční nebo osobní údaje.

Útoky sociálního inženýrství umožněné klonovanými hlasy

I když se takové podvody mohou stát ve větším měřítku, můžete je také najít kolem sebe denně. Možná si vzpomenete na situaci, kdy vám zavolal někdo, koho jste znali, a řekl, že byl zatčen a potřebuje peníze na kauci. Mohli použít hlasové nahrávky k replikaci původního hlasu osoby. Napadají vás nějaké takové případy?

Takové podvody sociálního inženýrství mohou ovlivnit vás nebo vaše blízké. Vzhledem k nedostatku dostatečných právních prostředků musí být jednotlivci vždy ostražití. Tyto podvody jsou obzvláště nebezpečné, protože deepfakes často znějí jako skutečný obchod.

Pokud například podvodník ví, jak mluví váš blízký, budete potřebovat pomoc s rozlišením mezi fyzickou osobou a jejím deepfaked hlasem.

Proč je Speaktor lepší alternativou ke klonování hlasu

Nebezpečí klonování hlasu jsou v tuto chvíli téměř jasná. Při neetickém nebo zlomyslném použití může mít škodlivé následky. Zde se AI generátor hlasu, jako je Speaktor , odděluje od ostatních nástrojů pro klonování hlasu poháněných AI.

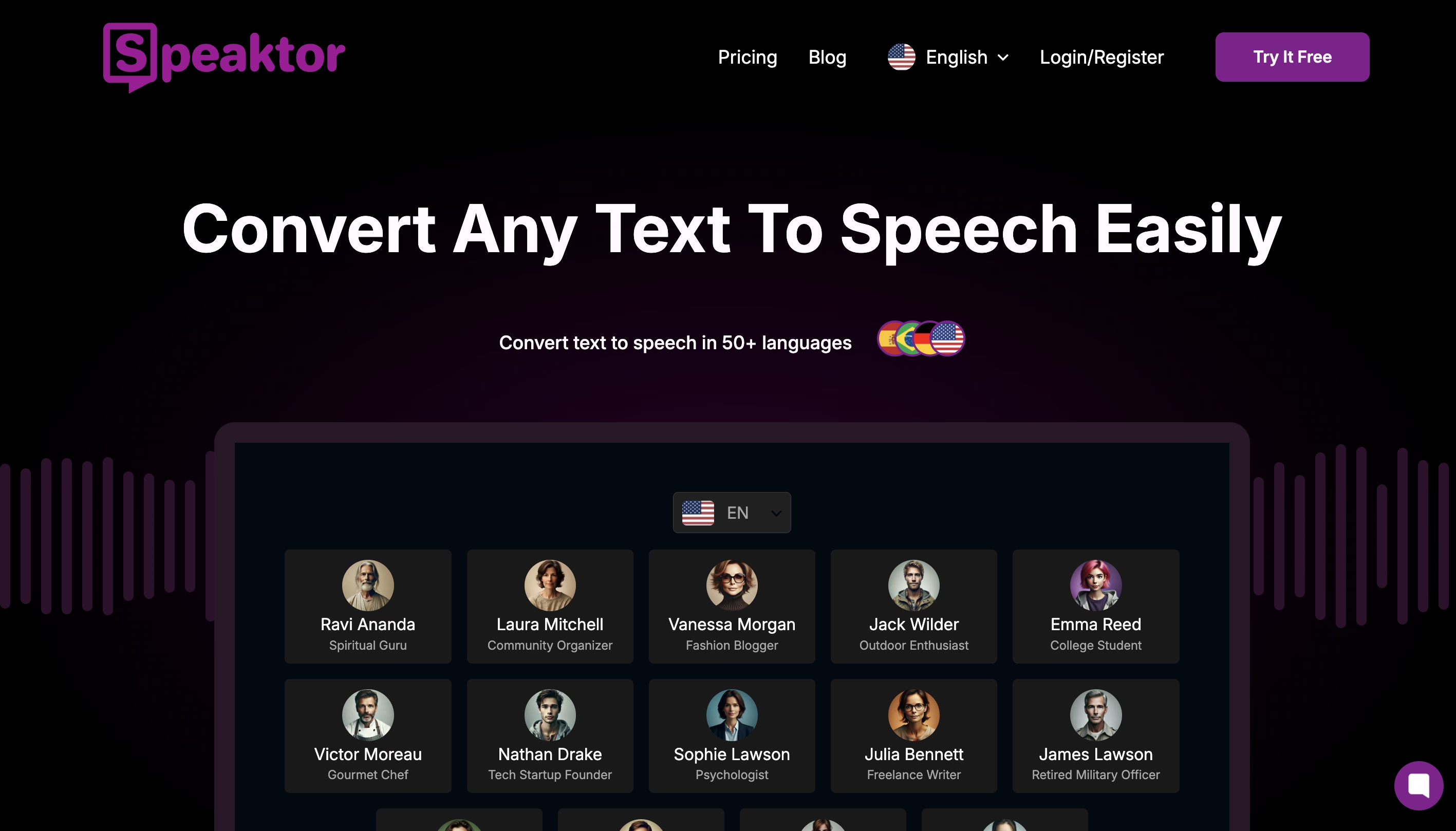

Speaktor je nástroj pro převod textu na řeč založený na AI, který využívá syntézu řeči a převádí psaný obsah na vysoce kvalitní mluvená slova. Speaktor používá hlasová data eticky, aniž by se vydávala za živou osobu. Je ideální pro tvůrce obsahu i marketéry, kteří mohou vytvářet hlasy generované AI.

Bezpečné a realistické neklonované hlasy

Díky přirozeně znějícím AI hlasům se Speaktor nespoléhá na technologie, jako je klonování hlasu, aby produkovala vysoce kvalitní výstupy. Tím se zcela eliminuje riziko klonování hlasu a odstraňují se veškeré obavy týkající se etiky nebo ochrany osobních údajů, které byste mohli mít.

Speaktor využívá technologii převodu textu na řeč k různým účelům a zajišťuje soukromí a bezpečnost.

Pomocí Speaktor můžete vytvořit VoiceOver, prezentaci nebo větší digitální přístupnost napříč vašimi marketingovými kanály.

Jaké jsou etické obavy klonování hlasu

Technologie klonování hlasu s sebou přináší několik etických problémů a problémů souvisejících s ochranou soukromí, které jsou v médiích zveličovány.

Problém s personalizovanými hlasovými klony v médiích

Média nabízejí výhodu masového šíření. Zneužití technologie klonování hlasu tak může vést ke krádeži identity. Ještě důležitější je, že může vést k pomluvám a dokonce narušit důvěru veřejnosti v jednotlivce nebo organizace. To se může stát, pokud je použita jako zbraň v neklidných časech nebo volbách.

Kromě otázek pomluvy a krádeže identity patří mezi další kritické oblasti zájmu:

- Souhlas a vlastnictví: Etické použití technologie klonování hlasu vyžaduje souhlas jednotlivce, jehož hlas je replikován To se často nestává, ale je zásadní zajistit osobní autonomii jednotlivce.

- Zneužití: Technologie klonování hlasu může být zneužita k sociálnímu inženýrství, phishingovým podvodům, šíření dezinformačních a dezinformačních kampaní, manipulaci s volebními a volebními vzorci a mnoho dalšího.

- Zachování soukromí jednotlivců: Nedostatek souhlasu při použití hlasu jednotlivce může narušit jeho soukromí Zabránění neoprávněnému použití lidského hlasu se tak stává prvořadým.

Jak se můžete chránit před podvody s klonováním hlasu?

Jednotlivci musí podniknout určité kroky, aby se ochránili před podvody s klonováním hlasu. To platí zejména s ohledem na rizika a obtížnost právních kroků, jak je uvedeno výše.

Praktické tipy, jak se vyhnout podvodům s klonovaným hlasem

Pokud chcete mít jistotu, že se nikdy nestanete obětí podvodu s klonováním hlasu, můžete se řídit několika praktickými tipy. Některé z nich zahrnují:

- Pomocí vícefaktorového ověřování pro citlivé nebo finanční účty minimalizujte riziko, že se k vašim osobním a finančním údajům dostanou osoby se zlými úmysly.

- Nezapojujte se do kontaktu s volajícími WHO působí podezřele Vyhněte se panice, pokud se ji někdo pokusí využít k tomu, aby z vás vytáhl peníze.

- Abyste se ujistili, že nejste podvedeni, zkuste ověřit identitu volajícího pomocí důvěryhodného média nebo nástroje.

- Vzhledem k tomu, že váš hlas může být použit k páchání podvodů nebo podvodů, měli byste se vyvarovat používání neznámých nebo nespolehlivých nástrojů pro klonování hlasu.

- Vyberte si zabezpečené služby, jako jsou Speaktor , které nevyžadují použití hlasu Generuje přizpůsobené hlasy čistě pomocí AI Zvažte použití spolehlivého rozšíření pro převod textu na řeč pro Chrome .

Závěr

Navzdory svým výhodám klonování hlasu poháněné AIs sebou vždy nese riziko zneužití.

Nárůst deepfakes a nárůst kybernetické kriminality dále způsobují, že je zásadní, aby se uživatelé spoléhali na bezpečnější alternativy. Ty musí používat pokročilé AI , aniž by narušovaly soukromí osob nebo se za ně vydávaly bez jejich souhlasu.

Speaktor nabízí neklonované, vysoce kvalitní TTS hlasy pro zvukové soubory. Tyto hlasy můžete použít ke generování řeči pro všechny vaše potřeby v oblasti tvorby obsahu a marketingu. Jedná se o etickou a spolehlivou alternativu k tradičním technologiím klonování hlasu.

Dubai, UAE

Dubai, UAE