Технологія голосового клонування останнім часом отримала неабияку частку преси, іноді лише з найкращих причин. Відомі митці та особистості подали до суду на окремих осіб та організації за використання такої технології для видачі себе за них.

У цьому посібнику досліджується темна сторона використання програмного забезпечення для клонування голосу, включаючи ризики та етичні проблеми, пов'язані з ним. Він також пропонує альтернативи, такі як Speaktor, які ви можете використовувати для своїх потреб.

Як працює клонування голосу AI і чому це ризиковано

Персоналізовані голосові клони для VoiceOver використовують штучний інтелект (AI) для ідентифікації та відтворення синтетичної версії голосу людини.

Люди використовують цих клонів по-різному, щоб створити враження, що голос належить людині, яку уособлюють. Вони відтворюють унікальні вокальні дані людини.

Подумайте про суперечки навколо позову Скарлетт Йоханнесен проти Open AI . Вона стверджувала, що вони імітували HER голос без HER згоди на свій голосовий чат-бот.

Як TTS із клонуванням голосу створює Deepfake голосів

Загроза діпфейків зростає вже кілька років. Це пов'язано з тим, що вони пов'язані з багатьма небезпеками. До них належать усе: маніпуляції на виборах, шахрайство, порнографія знаменитостей, дезінформаційні атаки та соціальна інженерія, а також кілька інших.

Ті WHO хто стикається з маніпульованим або синтетичним контентом, часто вірять у те, що бачать або чують. Це пов'язано з тим, що клонування голосу призначене для точного відтворення голосу людини, що часто має руйнівні наслідки.

Таким чином, перетворення тексту в мову має досить темну сторону, коли воно знаходиться в руках тих WHO хто не дбає про етичне використання такої технології. Вони також можуть мати зловмисні наміри під час використання функції клонування голосу.

Як згадувалося вище, генератор AI голосових клонів може бути використаний як зброя різними способами. Люди використовують ці голосові моделі, щоб впливати на людину або навіть маніпулювати великими верствами населення.

У статті The Guardian йдеться, що понад 250 британських знаменитостей входять до числа 4000 людей WHO стали жертвами порнографії Deepfake . Ключовим аспектом створення такої порнографії є використання технології клонування голосу. Він уособлює голос людини за межами її простого фізичного вигляду.

Ці випадки можуть серйозно зашкодити репутації людини, оскільки люди часто сприймають почуте або побачене за чисту монету.

Які найбільші загрози конфіденційності та безпеці під час клонування голосу

Як ви, напевно, зрозуміли на цьому етапі, використання голосового клонування несе з собою величезні загрози конфіденційності або безпеці. Він може порушити приватність людини, використовуючи її голос без її згоди. Однак це також може завдати шкоди на організаційному рівні. Шахраї часто використовують такі хитрощі, щоб обдурити керівника, який нічого не підозрює, щоб отримати критично важливі фінансові або особисті дані.

Атаки соціальної інженерії, що уможливлюються клонованими голосами

Хоча такі шахрайства можуть траплятися в більших масштабах, ви також можете знаходити їх навколо себе щодня. Можливо, ви зможете пригадати випадок, коли хтось із ваших знайомих зателефонував вам і сказав, що їх заарештували і їм потрібні гроші на заставу. Вони могли використовувати голосові записи, щоб відтворити оригінальний голос людини. Чи спадають на думку такі випадки?

Такі афери з соціальною інженерією можуть вплинути на вас або ваших близьких. З огляду на відсутність достатніх засобів правового захисту, люди завжди повинні бути пильними. Ці шахрайства особливо небезпечні, оскільки діпфейки часто звучать як справжня угода.

Наприклад, якщо шахрай знає, як говорить ваша близька людина, вам знадобиться допомога, щоб відрізнити фізичну особу від її глибоко підробленого голосу.

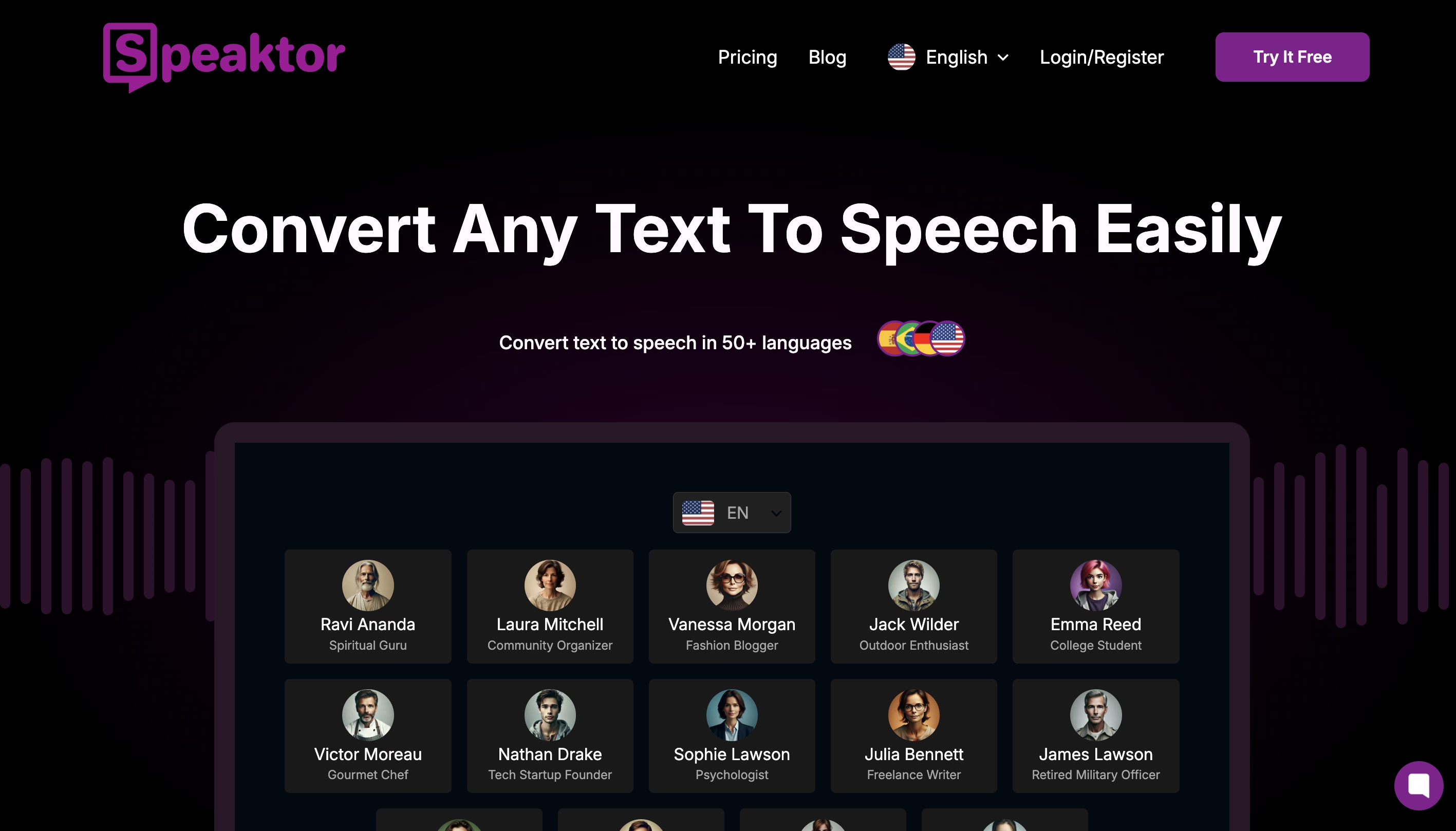

Чому Speaktor є кращою альтернативою клонуванню голосу

Небезпека клонування голосу на даний момент майже очевидна. Це може мати руйнівні наслідки при неетичному або зловмисному використанні. Саме тут AI генератор голосу, такий як Speaktor , відокремлює себе від інших інструментів клонування голосу на основі AI.

Speaktor — це інструмент перетворення тексту в мовлення на основі AI, який використовує синтез мови та перетворює письмовий контент на високоякісні усні слова. Speaktor використовує голосові дані з дотриманням етичних норм, не прикидаючись живою людиною. Він ідеально підходить як для творців контенту, так і для маркетологів для створення голосів, згенерованих AI.

Безпечні та реалістичні голоси без клонів

Завдяки природному звучанню AI голосів Speaktor не покладається на такі технології, як клонування голосу, для отримання високоякісних результатів. Це повністю виключає ризик клонування голосу та усуває будь-які етичні проблеми чи проблеми, пов'язані з конфіденційністю, які у вас можуть виникнути.

Speaktor використовує технологію перетворення тексту в мову для різних цілей і забезпечує конфіденційність і безпеку.

Ви можете використовувати Speaktor для створення VoiceOver, презентації або більшої цифрової доступності у своїх маркетингових каналах.

Які етичні проблеми клонування голосу

Технологія клонування голосу приносить із собою кілька етичних проблем та проблем, пов'язаних із конфіденційністю, які висвітлюються в засобах масової інформації.

Проблема з персоналізованими голосовими клонами в медіа

Засоби масової інформації пропонують вигоду від масового поширення. Таким чином, неправильне використання технології клонування голосу може призвести до крадіжки особистих даних. Що ще важливіше, це може призвести до наклепу і навіть підірвати довіру суспільства до окремих осіб чи організацій. Це може статися, якщо вона використовується як зброя під час неспокійних часів або виборів.

Окрім питань наклепу та крадіжки особистих даних, деякі з інших критично важливих питань, що викликають занепокоєння, включають:

- Згода та право власності: Етичне використання технології клонування голосу вимагає дозволу особи, голос якої відтворюється Часто цього не відбувається, але дуже важливо забезпечити особисту автономію індивіда.

- Зловживання: Технологія клонування голосу може бути неправильно використана для соціальної інженерії, фішингових шахрайств, поширення дезінформації та кампаній з дезінформації, маніпулювання виборчими моделями та шаблонами голосування та багато іншого.

- Збереження приватності особи: Відсутність згоди під час використання голосу особи може порушити її приватність Таким чином, недопущення несанкціонованого використання голосу людини набуває першочергового значення.

Як ви можете захистити себе від шахрайства з клонуванням голосу?

Люди повинні вжити певних заходів, щоб захистити себе від шахрайства з клонуванням голосу. Це особливо актуально з огляду на ризики та складність звернення до суду, про що говорилося вище.

Практичні поради, як не потрапити на гачок шахрайства з клонованим голосом

Якщо ви хочете гарантувати, що ніколи не станете жертвою шахрайства з клонуванням голосу, є кілька практичних порад, яких ви можете дотримуватися. Деякі з них включають:

- Використовуйте багатофакторну перевірку для конфіденційних або фінансових облікових записів, щоб мінімізувати ризики доступу зловмисників до ваших особистих і фінансових даних.

- Не спілкуйтеся з абонентами WHO які здаються підозрілими Уникайте паніки, якщо хтось намагається використати це, щоб витягнути з вас гроші.

- Щоб переконатися, що вас не обманюють, спробуйте підтвердити особу абонента за допомогою надійного носія або інструменту.

- Оскільки ваш голос може бути використаний для шахрайства або шахрайства, вам слід уникати використання невідомих або ненадійних інструментів клонування голосу.

- Обирайте безпечні сервіси, як-от Speaktor , які не вимагають використання голосу Він генерує індивідуальні голоси виключно за допомогою AI Розгляньте можливість використання надійного розширення Chrome із функцією перетворення тексту в мовлення .

Висновок

Незважаючи на свої переваги, клонування голосу на основі AIзавжди пов'язане з ризиком неправильного використання.

Крім того, зростання діпфейків і зростання кіберзлочинності змушують користувачів покладатися на безпечніші альтернативи. Вони повинні використовувати розширені AI , не порушуючи приватне життя особи та не видаючи себе за неї без її згоди.

Speaktor пропонує неклоновані, високоякісні TTS голоси для аудіофайлів. Ви можете використовувати ці голоси для створення мовлення для всіх ваших потреб у створенні контенту та маркетингу. Це етична та надійна альтернатива традиційним технологіям клонування голосу.

Dubai, UAE

Dubai, UAE