Gerador de Voz de Celebridade: Riscos, Regulamentações e Alternativas Responsáveis

Índice

- Como funcionam os geradores de voz de celebridade com IA?

- Quais são os riscos comuns da geração de voz de celebridade?

- Regulamentações da indústria sobre clonagem de voz de celebridades

- Como você deve proceder com geradores de voz de celebridade?

- Quais são os casos de uso responsáveis para IA de voz?

- Alternativa mais segura ao gerador de voz de celebridade

- Siga o caminho ético com ferramentas de voz com IA

Transcribe, Translate & Summarize in Seconds

Índice

- Como funcionam os geradores de voz de celebridade com IA?

- Quais são os riscos comuns da geração de voz de celebridade?

- Regulamentações da indústria sobre clonagem de voz de celebridades

- Como você deve proceder com geradores de voz de celebridade?

- Quais são os casos de uso responsáveis para IA de voz?

- Alternativa mais segura ao gerador de voz de celebridade

- Siga o caminho ético com ferramentas de voz com IA

Transcribe, Translate & Summarize in Seconds

TL;DR

Ferramentas de gerador de voz de celebridade são criativas, mas trazem grandes riscos como golpes, desinformação, danos à marca e disputas legais

Reguladores em todo o mundo estão agindo rapidamente para proteger vozes como parte da identidade pessoal

Casos de uso responsáveis de IA de voz incluem acessibilidade (restauração de fala perdida), localização (conteúdo multilíngue) e mídia criativa (narrativas, educação, paródia)

A escolha mais segura é evitar clonar pessoas reais e optar por plataformas como Speaktor, que fornece vozes sintéticas naturais em mais de 50 idiomas sem riscos legais ou éticos

Os geradores de voz de celebridade explodiram em popularidade, permitindo que qualquer pessoa faça uma estrela pop narrar um podcast, ou um ator famoso contar uma piada no seu grupo de chat.

Na superfície, a ferramenta parece divertida e inovadora. Por baixo, no entanto, a tecnologia levanta questões espinhosas sobre privacidade, legalidade e ética.

As ferramentas de gerador de voz de celebridade dependem de modelos avançados de IA que podem imitar tom, cadência e personalidade com uma precisão impressionante. Isso abre portas para usos criativos como dublagem de filmes em vários idiomas, tornando audiolivros mais envolventes ou oferecendo novas maneiras de comunicação para pessoas com perda de fala.

Mas há um lado mais sombrio: vozes clonadas já estão sendo usadas como arma em golpes, campanhas de desinformação e endossos não autorizados. Para celebridades, é uma ameaça direta à reputação e renda. Para indústrias como mídia, entretenimento e bancária, é um desafio regulatório e de confiança.

Como funcionam os geradores de voz de celebridade com IA?

Em sua essência, os geradores de voz de celebridade dependem de síntese de fala alimentada por IA. Eles usam gravações reais da voz de uma pessoa e treinam redes neurais para imitar seus padrões únicos.

O processo envolve dois componentes principais:

- Modelos de clonagem de voz: Modelos de aprendizado profundo analisam as características vocais de uma pessoa, como tom, timbre, ritmo e sotaque. Com amostras suficientes, o sistema constrói uma impressão vocal digital que captura a essência de como essa pessoa fala.

- Motores de texto para fala (TTS) ou fala para fala: Uma vez que o modelo aprendeu a voz, ele pode gerar novo áudio. Você pode digitar um texto (TTS) ou fornecer sua própria entrada falada (fala para fala), e a IA recria isso na voz clonada da celebridade.

Os sistemas modernos podem até capturar emoção e inflexão para fazer o resultado soar mais autêntico do que robótico. Como o treinamento e a renderização geralmente acontecem na nuvem, qualquer pessoa com um aplicativo amigável pode produzir áudio semelhante ao de celebridades em minutos.

Quais são os riscos comuns da geração de voz de celebridade?

1. Golpes e cibercrimes

Em um caso de alto perfil em 2024, um funcionário de uma empresa multinacional foi enganado a transferir mais de 25 milhões de dólares devido a uma videochamada deepfake com um CFO clonado. Chamadas de emergência falsas ou vozes clonadas estão sendo usadas para enganar vítimas a entregar dinheiro ou informações sensíveis. Esses ataques são mais difíceis de detectar do que phishing tradicional porque soam autênticos.

2. Batalhas legais

A voz de uma pessoa é considerada parte de sua identidade. Usá-la sem consentimento pode infringir seu direito de publicidade ou imagem, levando a processos judiciais. Em indústrias como publicidade, jogos ou cinema, o uso não autorizado da voz de uma celebridade pode violar contratos e desencadear disputas legais caras.

3. Danos à marca

Se a voz clonada de uma celebridade parecer endossar um produto ou opinião que nunca concordaram, isso pode erodir a confiança tanto na celebridade quanto na marca. Para empresas, a associação com clonagem de voz não autorizada pode ser vista como antiética e prejudicar a lealdade do cliente.

4. Desinformação

Deepfakes de áudio facilitam a disseminação de informações falsas ou a manipulação da opinião pública. Um clipe de notícias falsas convincente ou uma declaração política em uma voz conhecida pode ser especialmente prejudicial porque as pessoas tendem a acreditar no que ouvem.

5. Riscos de segurança

Entre 2024 e 2025, golpes de imitação por IA aumentaram alarmantemente em 148%. Sistemas de autenticação por voz, amplamente usados em bancos e atendimento ao cliente, agora são alvos vulneráveis. Com uma voz clonada, atacantes podem contornar verificações de identidade e acessar contas sensíveis.

Regulamentações da indústria sobre clonagem de voz de celebridades

Estados Unidos

- Lei ELVIS do Tennessee (2024): A primeira lei dos EUA que protege explicitamente as vozes dos artistas contra o uso indevido por IA. Torna a clonagem não autorizada um crime e foi impulsionada com forte apoio de gravadoras e sindicatos de artistas.

- Lei NO FAKES (a ser reintroduzida em 2025): Um projeto de lei federal bipartidário que proibiria réplicas de IA não autorizadas da voz ou imagem de uma pessoa. Inclui exceções para paródia e jornalismo, mas introduz um processo de remoção para que as vítimas recuperem o controle de sua identidade.

- Lei TAKE IT DOWN (2025): Embora focada principalmente em imagens íntimas não consensuais, a Lei TAKE IT DOWN sinaliza que a regulamentação de deepfakes agora está firmemente na agenda de Washington, estabelecendo as bases para proteções mais amplas.

Europa

- Lei de IA da UE (em vigor em 2024): A primeira lei abrangente de IA do mundo. Classifica tecnologias de deepfake (incluindo clonagem de voz) como “alto risco” quando usadas de forma enganosa, exigindo divulgação clara e conformidade mais rigorosa.

- Proposta de lei da Dinamarca (2025/26): Uma emenda inovadora à lei de direitos autorais que daria às pessoas direitos de propriedade explícitos sobre sua voz, rosto e imagem. Vítimas de clonagem não autorizada poderiam exigir remoções e compensação. A proposta de lei pode se tornar um modelo para outros estados da UE.

Além dos EUA e Europa, outros países também estão se movendo rapidamente para enfrentar os riscos da clonagem de voz de celebridades, ou clonagem de voz em geral.

Da Ásia à América Latina, os formuladores de políticas estão explorando novas regras que equilibram inovação com proteção contra roubo de identidade e desinformação.

As abordagens variam, mas a tendência global é clara: reguladores da indústria estão tratando a clonagem de voz como uma questão de alta prioridade que exige clareza legal e salvaguardas para indivíduos.

Como você deve proceder com geradores de voz de celebridade?

- Obtenha consentimento explícito: Se você pretende usar a voz de uma pessoa real, obtenha aprovação por escrito dela ou de seu espólio. É a proteção mais clara contra repercussões legais ou de reputação.

- Seja transparente com o público: Sempre divulgue quando uma voz é gerada por IA. Um simples aviso constrói confiança e evita a percepção de engano.

- Evite áreas de alto risco: Mensagens políticas, conselhos de saúde, instruções financeiras e endossos comerciais são especialmente perigosos sem licenças.

- Escolha plataformas compatíveis: Confie em ferramentas que oferecem marca d'água, registros de uso e recursos de remoção, mostrando que levam o uso indevido a sério.

A clonagem de voz de celebridade pode ser cheia de riscos, mas a tecnologia de IA de voz em si tem aplicações significativas e éticas.

Quais são os casos de uso responsáveis para IA de voz?

Acessibilidade

A IA de voz oferece às pessoas que perderam sua fala natural uma maneira de se comunicar novamente. Ao treinar modelos em gravações passadas, indivíduos podem preservar ou até mesmo restaurar suas próprias vozes. Para outros, vozes de IA com som natural tornam leitores de tela, dispositivos assistivos e interações digitais cotidianas mais inclusivas.

Você sabia:

Após uma cirurgia cerebral, Lexi Bogan, de 21 anos perdeu a capacidade de falar. Usando um vídeo de 15 segundos, pesquisadores trabalharam com a OpenAI para recriar sua voz adolescente, que ela agora usa através de um aplicativo para se comunicar e lidar com tarefas cotidianas.

Localização

Geradores de voz com IA podem ajudar a escalar conteúdo em diferentes idiomas sem sacrificar a expressão. Desde a dublagem de filmes e programas de TV até a disponibilização global de materiais de e-learning ou audiolivros, vozes de IA licenciadas tornam a localização mais rápida, acessível e envolvente.

Mídia criativa e narrativa

Artistas, educadores e criadores estão experimentando vozes de IA para paródia, sátira e narrativas imersivas. Quando o público é claramente informado que as vozes são sintéticas, a IA pode adicionar novas camadas de criatividade, reviver narrações históricas, experimentar vozes de personagens ou expandir os limites da arte digital.

Alternativa mais segura ao gerador de voz de celebridade

Se você deseja os benefícios da IA de voz sem os riscos legais ou éticos, a opção mais segura é usar ferramentas projetadas para acessibilidade e criação de conteúdo, em vez de imitação.

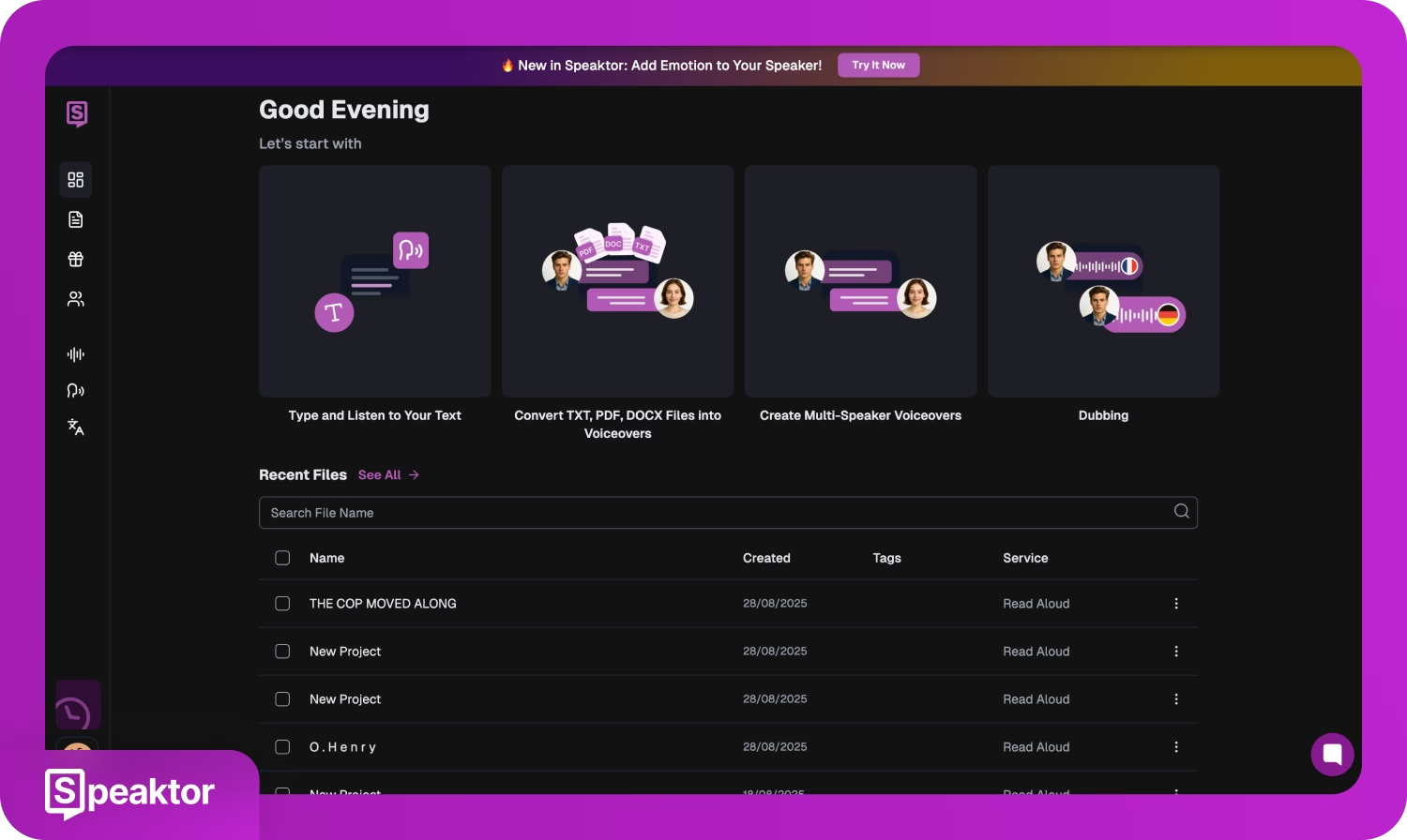

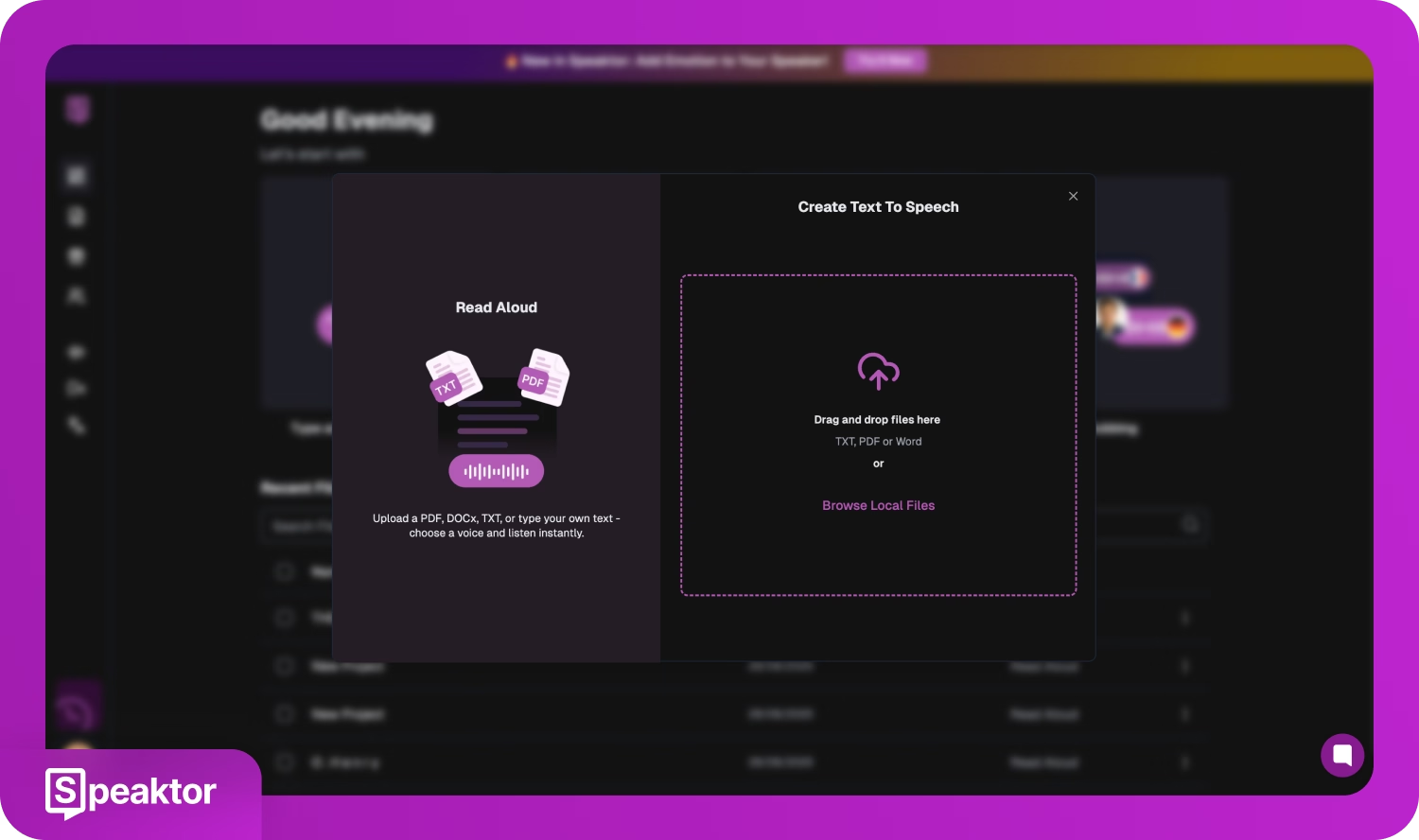

Uma dessas opções é o Speaktor. Em vez de clonar pessoas reais, o Speaktor oferece uma biblioteca de vozes sintéticas naturais em vários idiomas. É amplamente utilizado para criar narrações com IA, audiolivros, módulos de e-learning, podcasts e também para tornar o conteúdo acessível para pessoas com dificuldades de leitura.

Como as vozes do Speaktor não estão vinculadas a celebridades, você obtém as vantagens da tecnologia de voz com IA: escalabilidade, clareza e suporte multilíngue, sem o risco de violar os direitos de identidade de alguém.

Veja por que o Speaktor se destaca como um aplicativo de narração com IA:

- Permite síntese de voz em mais de 50 idiomas e dialetos

- Oferece fala gerada por IA realista e expressiva

- Permite colar texto ou carregar documentos em formatos PDF, TXT ou DOCX

- Oferece uma ampla variedade de vozes e configurações como tom, estilo, emoção e ritmo, permitindo áudio personalizado para diferentes públicos

- Suporta exportação fácil de áudio em formatos MP3 ou WAV

- Vem com um painel web intuitivo e aplicativo móvel; acessível em desktop, Android e iOS

Siga o caminho ético com ferramentas de voz com IA

Os geradores de voz de celebridade certamente parecem empolgantes, mas os riscos de disputas legais, danos à reputação e repressão regulatória geralmente superam a novidade.

A escolha mais segura é evitar ferramentas que imitam pessoas reais e confiar em ferramentas de geração de voz com IA ou software de texto para fala projetados para acessibilidade, criatividade e produção de conteúdo.

É aí que plataformas como o Speaktor entram. Ao oferecer uma ampla gama de vozes sintéticas naturais em vários idiomas, o Speaktor proporciona os benefícios da tecnologia de voz com IA sem as preocupações éticas ou legais relacionadas à clonagem.

Se você deseja usar vozes de IA de forma responsável, comece a experimentar o Speaktor hoje!

Perguntas frequentes

Não, a menos que você tenha consentimento explícito por escrito para usar a voz da celebridade. Usar vozes de celebridades sem consentimento pode levar a ações judiciais, danos à marca e até fraudes. Se seu objetivo é simplesmente converter texto em narração de alta qualidade, um gerador de voz de IA realista como o Speaktor oferece uma alternativa mais segura sem personificar figuras públicas.

Um modificador de voz de celebridade imita uma pessoa específica, enquanto um gerador de voz de IA cria vozes sintéticas não vinculadas a identidades reais. O primeiro levanta preocupações de privacidade e direitos autorais, enquanto o segundo é projetado para locuções profissionais, audiolivros ou e-learning. Com ferramentas como o Speaktor, você pode gerar áudio em vários idiomas sem ultrapassar limites legais.

Sim. Um gerador de voz de celebridade com IA pode capturar o tom, a entonação e as nuances linguísticas dos padrões de fala humana. No entanto, precisão não equivale a permissão. Esses sistemas podem imitar a voz de uma celebridade desejada, mas a abordagem mais segura é usar plataformas que produzam vozes de IA expressivas, mas neutras, para projetos criativos.

Sim. Muitas plataformas fornecem uma opção gratuita de gerador de voz de IA para ajudar os usuários a testar recursos. O Speaktor, por exemplo, permite converter texto em saídas de voz de IA naturais em vários idiomas para que você possa criar gravações de voz para vídeos de treinamento, podcasts, e-books ou conteúdo de mídia social sem depender de clones não autorizados de voz de celebridade com IA. Você pode experimentá-lo gratuitamente!

Sim. A tecnologia de voz realista atual torna possível alcançar narrações com qualidade de estúdio sem imitações de voz de celebridades. Por exemplo, o gerador de voz de IA realista do Speaktor fornece arquivos de áudio expressivos e naturais que rivalizam com dubladores profissionais.

Usar um gerador de voz de celebridade com IA pode atrair atenção a curto prazo, mas também expõe as empresas a disputas de direitos autorais, multas regulatórias e danos à reputação. As marcas correm o risco de perder confiança se uma voz gerada for confundida com um endosso real. É por isso que as empresas frequentemente escolhem geradores de voz de IA como o Speaktor, que fornecem qualidade de voz escalável sem imitar vozes únicas de celebridades.