Generirajte prirodni zvuk u velikim količinama pomoću Speaktorove AI tehnologije za pretvaranje teksta u govor. Ovaj realistični generator glasa pruža prirodno zvučeće glasove i višejezičnu podršku — savršeno za stvaranje glasovnih naracija, pretvaranje teksta u audio ili korištenje značajki čitanja naglas.

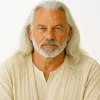

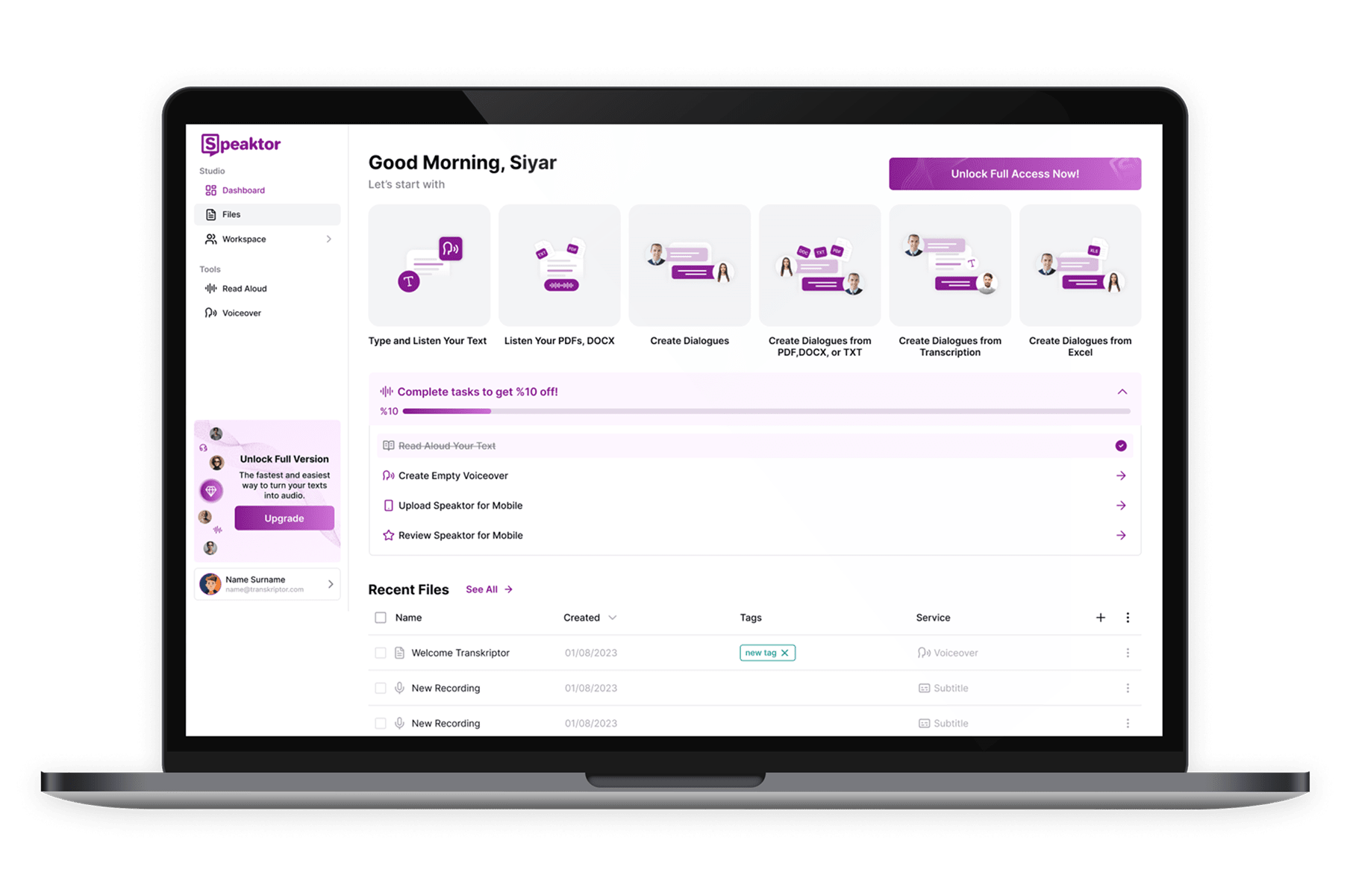

Proizvedite glasovne naracije studijske kvalitete za videozapise, prezentacije i podcaste koristeći Speaktorov AI generator glasa. Učitajte svoje skripte izravno ili uvezite sadržaj putem Excela za učinkovito stvaranje serije glasovnih naracija. Odaberite između niza realističnih glasova i više opcija govornika, što ga čini savršenim za kreatore, marketinške stručnjake i tvrtke.

Koristite Speaktorov AI pretvarač teksta u govor za pretvaranje bilo kojeg teksta u audio i slušajte dok obavljate više zadataka istovremeno. Odaberite između prirodno zvučećih glasova na više od 50 jezika za čitanje naglas članaka, e-mailova i dokumenata s lakoćom.

Stvorite profesionalni audio za bilo koju platformu sa Speaktorovim AI generatorom zvuka. Bez obzira proizvodite li YouTube videozapise, dijelite priče na TikToku, objavljujete na Instagramu, objavljujete Reels s glasovnom naracijom ili snimate podcaste, Speaktor vam pomaže trenutno pretvoriti tekst u MP3 ili WAV datoteke spremne za upotrebu.

Pristupite Speaktorovom AI pretvaraču teksta u govor i generatoru glasa izravno u bilo kojem pregledniku. Savršeno za stvaranje glasovnih naracija, audio knjiga i marketinških materijala s tehnologijom pretvaranja teksta u govor na bilo kojem računalu.

Započnite u nekoliko sekundi bez krivulje učenja. Speaktorov AI alat za pretvaranje teksta u govor čini pretvaranje teksta u prirodno zvučeći audio brzo, jednostavno i bez napora.

Stvorite visokokvalitetne AI glasovne zapise za djelić cijene tradicionalnog snimanja glasa. Speaktor nudi cjenovno pristupačne planove.

Pretvorite tekst u govor izravno unutar Speaktora bez dodatnih koraka. Trenutno pretvorite bilo koji pisani sadržaj u audio za slušanje bez ruku bilo kada i bilo gdje.

Pretvaranje teksta u govor (TTS) je tehnologija pokretana umjetnom inteligencijom koja pretvara pisani tekst u govorni audio. Najčešće se koristi za slušanje članaka, knjiga, scenarija i drugog sadržaja, što ga čini idealnim za multitasking, poboljšanje pristupačnosti i stvaranje visokokvalitetnih glasovnih zapisa.

Pretvaranje teksta u govor radi pomoću umjetne inteligencije koja pretvara pisani tekst u govorni audio. Speaktor koristi napredne AI glasovne modele za proizvodnju prirodno zvučećih glasovnih zapisa iz bilo kojeg teksta u samo nekoliko klikova.

Pretvaranje teksta u govor nudi mnoge prednosti uključujući povećanu pristupačnost, podršku za multitasking, poboljšano pamćenje pri učenju i bržu produkciju sadržaja. Idealno je za studente, profesionalce i kreatore sadržaja.

AI glasovna naracija je sintetski audio zapis generiran umjetnom inteligencijom iz pisanog teksta. Speaktor omogućuje korisnicima stvaranje profesionalnih glasovnih zapisa bez snimanja vlastitog glasa, čineći stvaranje sadržaja bržim i lakšim.

Pretvaranje teksta u govor koristi širok spektar ljudi uključujući studente, edukatore, marketingaše, kreatore sadržaja, korisnike s oštećenjem vida i tvrtke kojima je potreban skalabilan glasovni sadržaj za obuku, medije ili korisničku podršku.

Moderne AI glasovne naracije zvuče vrlo realistično zahvaljujući napretku u dubokom učenju i sintezi govora. Mnogi alati sada nude glasove koji oponašaju ljudski ton, emocije i tempo, čineći ih prikladnima za profesionalnu upotrebu.

Pretvaranje teksta u govor odnosi se na opći proces pretvaranja teksta u govorni audio, dok se AI glasovna naracija više fokusira na stvaranje prirodnog, izražajnog i produkcijski spremnog zvuka za korištenje u medijima, marketingu i sadržaju.

AI glasovne naracije mogu zamijeniti ljudske glasovne glumce za mnoge zadatke poput video objašnjenja, demonstracija proizvoda ili interne obuke. Međutim, ljudski glasovni talent još uvijek je preferiran za projekte koji zahtijevaju emocionalne nijanse i izvedbu.

Da, korištenje AI glasovnih naracija je legalno sve dok imate pravo koristiti tekst i poštujete uvjete licenciranja glasovnog softvera. Uvijek osigurajte da sadržaj ne krši autorska prava ili lažno predstavlja stvarne osobe.