Ģenerējiet dzīvīgu audio lielā apjomā ar Speaktor mākslīgā intelekta teksta pārvēršanu runā. Šis reālistiskais balss ģenerators nodrošina dabiski skanošas balsis un daudzvalodu atbalstu — ideāli piemērots balss ierakstu ģenerēšanai, teksta pārvēršanai audio vai teksta nolasīšanas funkciju izmantošanai.

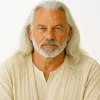

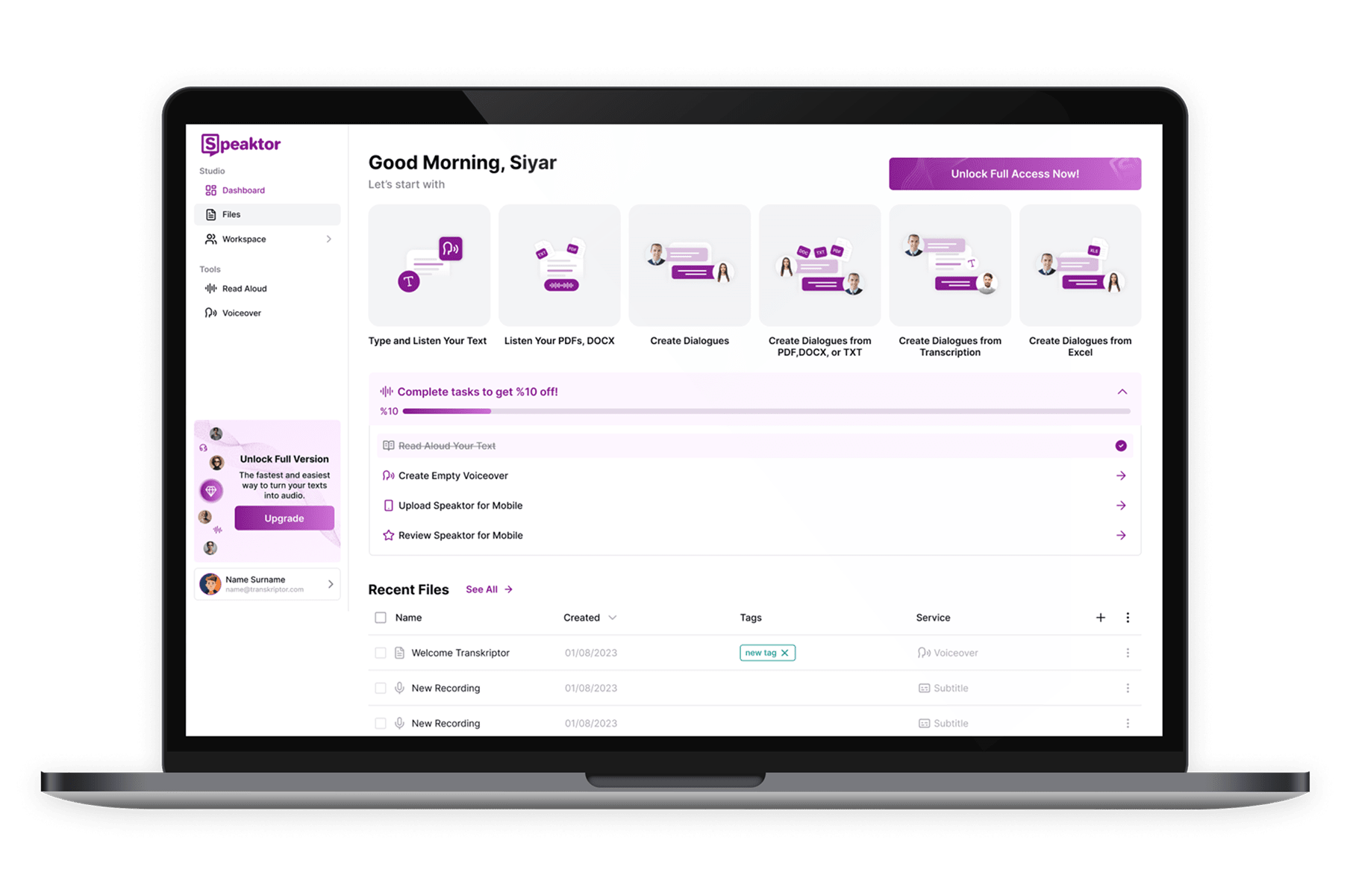

Radiet studijas kvalitātes balss ierakstus video, prezentācijām un podkāstiem, izmantojot Speaktor mākslīgā intelekta balss ģeneratoru. Augšupielādējiet savus scenārijus tieši vai importējiet saturu caur Excel efektīvai balss ierakstu veidošanai. Izvēlieties no dažādām reālistiskām balsīm un vairāku runātāju opcijām, kas padara to ideāli piemērotu satura veidotājiem, mārketinga speciālistiem un uzņēmumiem.

Izmantojiet Speaktor mākslīgā intelekta teksta pārvēršanas runā konvertētāju, lai pārvērstu jebkuru tekstu audio un klausītos, veicot vairākus uzdevumus vienlaikus. Izvēlieties no dabiski skanošām balsīm vairāk nekā 50 valodās, lai viegli nolasītu rakstus, e-pastus un dokumentus.

Veidojiet profesionālu audio jebkurai platformai ar Speaktor mākslīgā intelekta audio ģeneratoru. Neatkarīgi no tā, vai veidojat YouTube video, dalāties ar stāstiem TikTok, publicējat Instagram, veidojat Reels ar balss ierakstiem vai ierakstāt podkāstus, Speaktor palīdz jums nekavējoties pārvērst tekstu gatavos MP3 vai WAV failos.

Piekļūstiet Speaktor mākslīgā intelekta teksta pārvēršanas runā konvertētājam un balss ģeneratoram tieši jebkurā pārlūkprogrammā. Ideāli piemērots balss ierakstu, audioknigu un mārketinga materiālu veidošanai ar teksta pārvēršanas runā tehnoloģiju jebkurā datorā.

Sāciet darbu sekundēs bez nepieciešamības mācīties. Speaktor mākslīgā intelekta teksta-runas rīks padara teksta pārvēršanu dabīgi skanošā audio ātru, vienkāršu un bez piepūles.

Veidojiet augstas kvalitātes mākslīgā intelekta balss ierakstus par daļu no tradicionālā balss ieraksta izmaksām. Speaktor piedāvā budžetam draudzīgus plānus.

Pārvērtiet tekstu runā tieši Speaktor vidē bez papildu soļiem. Nekavējoties pārvērtiet jebkuru rakstīto saturu audio formātā, lai to varētu klausīties bez rokām jebkurā laikā un vietā.

Teksta pārvēršana runā (TTS) ir tehnoloģija, ko darbina mākslīgais intelekts, kas pārvērš rakstītu tekstu runātā audio. To bieži izmanto, lai klausītos rakstus, grāmatas, scenārijus un citu saturu, padarot to ideālu vairāku uzdevumu veikšanai vienlaikus, uzlabojot pieejamību un veidojot augstas kvalitātes balss ierakstus.

Teksta pārvēršana runā darbojas, izmantojot mākslīgo intelektu, lai pārvērstu rakstītu tekstu runātā audio. Speaktor izmanto modernos MI balss modeļus, lai radītu dabiski skanošus balss ierakstus no jebkura teksta ar dažiem klikšķiem.

Teksta pārvēršana runā piedāvā daudzas priekšrocības, tostarp palielinātu pieejamību, atbalstu vairāku uzdevumu veikšanai vienlaikus, uzlabotu mācīšanās saglabāšanu un ātrāku satura veidošanu. Tā ir ideāla gan studentiem, gan profesionāļiem, gan satura veidotājiem.

MI balss ieraksts ir sintētisks audio ieraksts, ko ģenerē mākslīgais intelekts no rakstīta teksta. Speaktor ļauj lietotājiem veidot profesionālus balss ierakstus bez savas balss ierakstīšanas, padarot satura veidošanu ātrāku un vienkāršāku.

Teksta pārvēršanu runā izmanto plašs cilvēku loks, tostarp studenti, pedagogi, mārketinga speciālisti, satura veidotāji, cilvēki ar redzes traucējumiem un uzņēmumi, kuriem nepieciešams mērogojams balss saturs apmācībai, medijiem vai klientu atbalstam.

Mūsdienu MI balss ieraksti skan ļoti reālistiski, pateicoties sasniegumiem dziļajā mācīšanās un runas sintēzē. Daudziem rīkiem tagad ir balsis, kas atdarina cilvēka toni, emocijas un tempu, padarot tos piemērotus profesionālai lietošanai.

Teksta pārvēršana runā attiecas uz vispārējo procesu, kad teksts tiek pārvērsts runātā audio, savukārt MI balss ieraksts vairāk koncentrējas uz dabiska, izteiksmīga un ražošanai gatava audio radīšanu izmantošanai medijos, mārketingā un saturā.

MI balss ieraksti var aizstāt cilvēku balss aktierus daudziem uzdevumiem, piemēram, skaidrojošiem video, produktu demonstrācijām vai iekšējai apmācībai. Tomēr cilvēku balss talants joprojām ir vēlamāks projektiem, kuriem nepieciešama emocionāla nianse un izpildījums.

Jā, MI balss ierakstu izmantošana ir likumīga, ja jums ir tiesības izmantot tekstu un jūs ievērojat balss programmatūras licencēšanas noteikumus. Vienmēr pārliecinieties, ka saturs nepārkāpj autortiesības vai neimitē reālas personas.