Generer livaktig lyd i stor skala med Speaktors AI tekst-til-tale. Denne realistiske stemmegeneratoren leverer naturlig lydende stemmer og flerspråklig støtte – perfekt for å generere voiceovers, konvertere tekst til lyd, eller bruke høytlesningsfunksjoner.

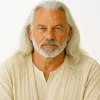

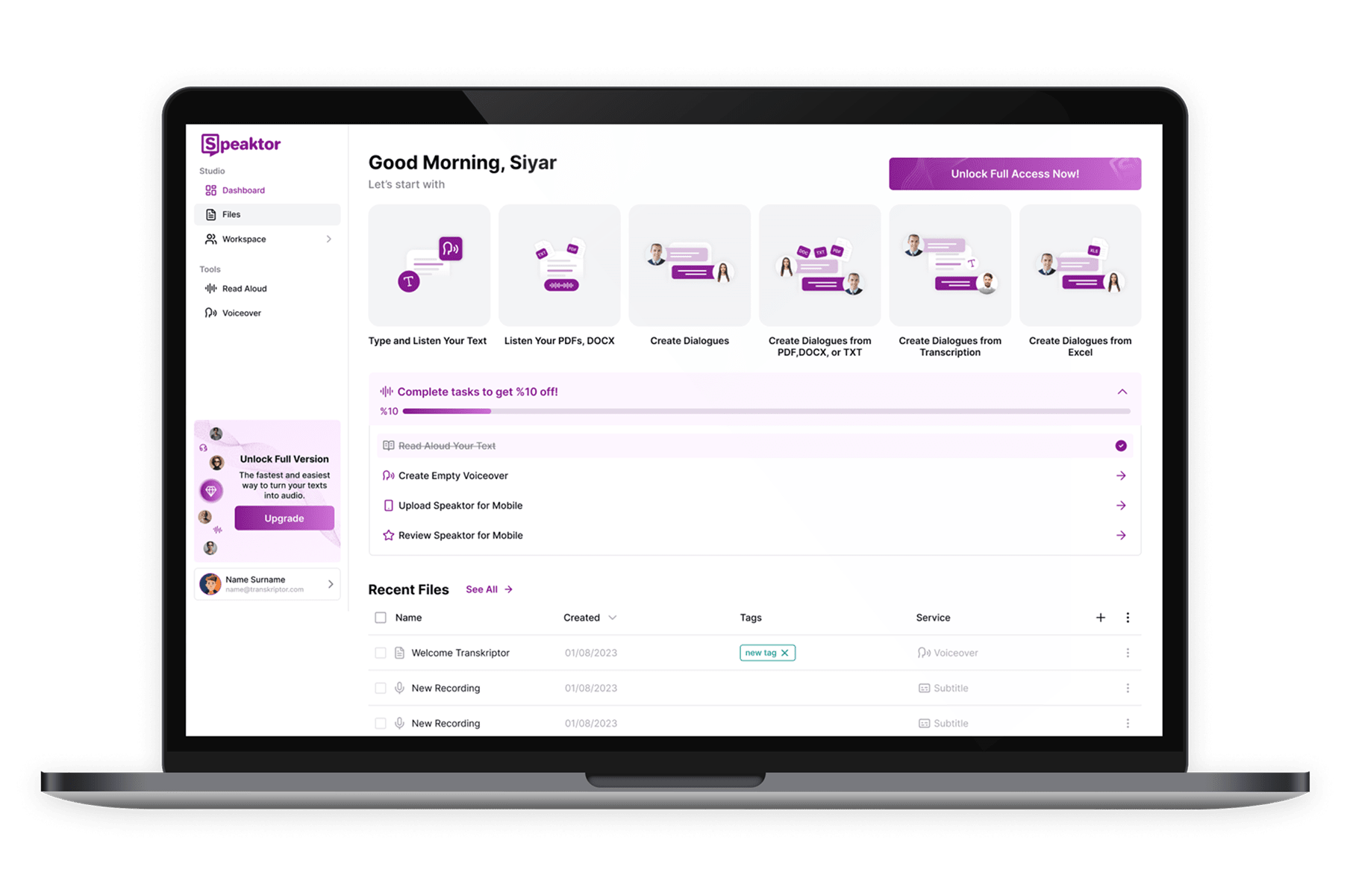

Produser studiokvalitets voiceovers for videoer, presentasjoner og podcaster ved hjelp av Speaktors AI-stemmegenerator. Last opp manusene dine direkte eller importer innhold via Excel for effektiv batchproduksjon av voiceovers. Velg blant et utvalg av realistiske stemmer og flere høyttalervalg, noe som gjør det perfekt for skapere, markedsførere og bedrifter.

Bruk Speaktors AI-drevne tekst-til-tale-konverter for å konvertere enhver tekst til lyd og lytte mens du multitasker. Velg blant naturlig lydende stemmer på over 50 språk for å lese høyt artikler, e-poster og dokumenter med letthet.

Lag profesjonell lyd for enhver plattform med Speaktors AI-lydgenerator. Enten du produserer YouTube-videoer, deler historier på TikTok, poster på Instagram, publiserer Reels med voiceover, eller tar opp podcaster, hjelper Speaktor deg med å umiddelbart gjøre tekst om til bruksklare MP3- eller WAV-filer.

Få tilgang til Speaktors AI tekst-til-tale-konverter og stemmegenerator direkte i hvilken som helst nettleser. Perfekt for å lage voiceovers, lydbøker og markedsføringsmaterialer med tekst-til-tale-teknologi på hvilken som helst datamaskin.

Kom i gang på sekunder uten læringskurve. Speaktors AI tekst-til-tale-verktøy gjør konvertering av tekst til naturlig lydende lyd raskt, enkelt og uanstrengt.

Lag høykvalitets AI-stemmeinnspillinger til en brøkdel av kostnaden for tradisjonelle stemmeopptakk. Speaktor tilbyr budsjettsvennlige planer.

Konverter tekst til tale direkte i Speaktor uten ekstra trinn. Gjør umiddelbart skriftlig innhold om til lyd for håndfri lytting når som helst og hvor som helst.

Tekst-til-tale (TTS) er en teknologi drevet av kunstig intelligens som konverterer skrevet tekst til talt lyd. Det brukes vanligvis til å lytte til artikler, bøker, manus og annet innhold, noe som gjør det ideelt for multitasking, forbedring av tilgjengelighet og for å lage taleopptak av høy kvalitet.

Tekst-til-tale fungerer ved å bruke kunstig intelligens til å konvertere skrevet tekst til talt lyd. Speaktor bruker avanserte AI-stemmemodeller for å produsere naturlig lydende taleopptak fra hvilken som helst tekst med bare noen få klikk.

Tekst-til-tale tilbyr mange fordeler, inkludert økt tilgjengelighet, støtte for multitasking, forbedret læringsretensjon og raskere innholdsproduksjon. Det er ideelt for både studenter, fagfolk og innholdsskapere.

En AI-voiceover er et syntetisk lydopptak generert av kunstig intelligens fra skrevet tekst. Speaktor lar brukere lage profesjonelle taleopptak uten å ta opp sin egen stemme, noe som gjør innholdsproduksjon raskere og enklere.

Tekst-til-tale brukes av et bredt spekter av mennesker, inkludert studenter, pedagoger, markedsførere, innholdsskapere, synshemmede brukere og bedrifter som trenger skalerbart stemmeinnhold for opplæring, media eller kundestøtte.

Moderne AI-voiceovers høres svært realistiske ut takket være fremskritt innen dyplæring og talesyntese. Mange verktøy tilbyr nå stemmer som etterligner menneskelig tone, følelse og tempo, noe som gjør dem egnet for profesjonell bruk.

Tekst-til-tale refererer til den generelle prosessen med å konvertere tekst til talt lyd, mens AI-voiceover fokuserer mer på å skape naturlig, uttrykksfull og produksjonsklar lyd for bruk i media, markedsføring og innhold.

AI-voiceovers kan erstatte menneskelige stemmeskuespillere for mange oppgaver som forklaringsvideoer, produktdemoer eller intern opplæring. Imidlertid foretrekkes fortsatt menneskelig stemmetalent for prosjekter som krever emosjonell nyanse og prestasjon.

Ja, det er lovlig å bruke AI-voiceovers så lenge du har rett til å bruke teksten og overholder lisensvilkårene for stemmeprogramvaren. Sørg alltid for at innholdet ikke krenker opphavsrettigheter eller utgir seg for å være virkelige personer.