Generujte realistické audio vo veľkom meradle pomocou Speaktor AI prevodu textu na reč. Tento realistický generátor hlasu poskytuje prirodzene znejúce hlasy a podporu viacerých jazykov – ideálny na vytváranie hlasových komentárov, konverziu textu na zvuk alebo používanie funkcií predčítavania.

Produkujte hlasové komentáre v štúdiovej kvalite pre videá, prezentácie a podcasty pomocou generátora AI hlasu Speaktor. Nahrajte svoje scenáre priamo alebo importujte obsah cez Excel pre efektívnu dávkovú tvorbu hlasových komentárov. Vyberte si z radu realistických hlasov a viacerých možností hovoriacich, čo je ideálne pre tvorcov, marketérov a firmy.

Použite konvertor textu na reč Speaktor s umelou inteligenciou na konverziu akéhokoľvek textu na zvuk a počúvajte počas vykonávania viacerých úloh. Vyberte si z prirodzene znejúcich hlasov vo viac ako 50 jazykoch na predčítanie článkov, e-mailov a dokumentov s ľahkosťou.

Vytvárajte profesionálne audio pre akúkoľvek platformu s generátorom zvuku Speaktor AI. Či už produkujete videá na YouTube, zdieľate príbehy na TikToku, publikujete na Instagrame, zverejňujete Reels s hlasovým komentárom alebo nahrávate podcasty, Speaktor vám pomôže okamžite premeniť text na pripravené súbory MP3 alebo WAV.

Pristupujte ku konvertoru textu na reč a generátoru hlasu Speaktor AI priamo v ľubovoľnom prehliadači. Ideálne pre vytváranie hlasových komentárov, audiokníh a marketingových materiálov s technológiou prevodu textu na reč na akomkoľvek počítači.

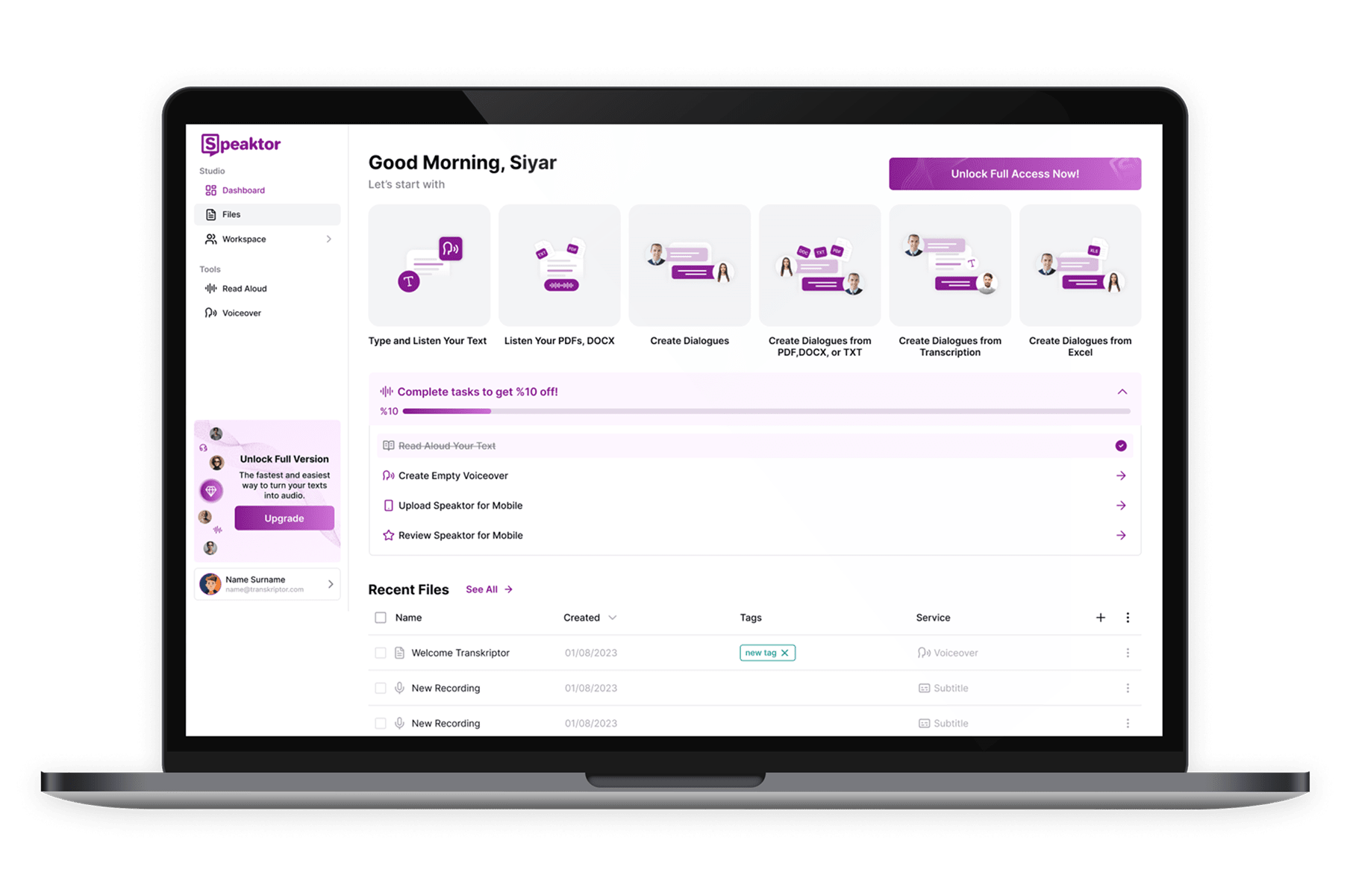

Začnite v priebehu sekúnd bez krivky učenia. AI nástroj Speaktor na prevod textu na reč premieňa text na prirodzene znejúci zvuk rýchlo, jednoducho a bez námahy.

Vytvárajte vysokokvalitné AI hlasové nahrávky za zlomok ceny tradičného nahrávania hlasu. Speaktor ponúka cenovo výhodné plány.

Prevádzajte text na reč priamo v Speaktore bez ďalších krokov. Okamžite premeňte akýkoľvek písaný obsah na zvuk pre hands-free počúvanie kedykoľvek a kdekoľvek.

Prevod textu na reč (TTS) je technológia poháňaná umelou inteligenciou, ktorá premieňa písaný text na hovorený zvuk. Bežne sa používa na počúvanie článkov, kníh, scenárov a iného obsahu, čo je ideálne pre multitasking, zlepšenie prístupnosti a vytváranie vysokokvalitných hlasových nahrávok.

Prevod textu na reč funguje pomocou umelej inteligencie, ktorá premieňa písaný text na hovorený zvuk. Speaktor využíva pokročilé hlasové modely AI na vytváranie prirodzene znejúcich hlasových nahrávok z akéhokoľvek textu len niekoľkými kliknutiami.

Prevod textu na reč ponúka mnoho výhod vrátane zvýšenej prístupnosti, podpory multitaskingu, zlepšeného zapamätávania pri učení a rýchlejšej tvorby obsahu. Je ideálny pre študentov, profesionálov aj tvorcov obsahu.

AI hlasový komentár je syntetická zvuková nahrávka generovaná umelou inteligenciou z písaného textu. Speaktor umožňuje používateľom vytvárať profesionálne hlasové nahrávky bez nahrávania vlastného hlasu, čím je tvorba obsahu rýchlejšia a jednoduchšia.

Prevod textu na reč používa široká škála ľudí vrátane študentov, pedagógov, marketérov, tvorcov obsahu, zrakovo postihnutých používateľov a firiem, ktoré potrebujú škálovateľný hlasový obsah pre školenia, médiá alebo zákaznícku podporu.

Moderné AI hlasové nahrávky znejú veľmi realisticky vďaka pokrokom v hlbokom učení a syntéze reči. Mnohé nástroje teraz ponúkajú hlasy, ktoré napodobňujú ľudský tón, emócie a tempo, čo ich robí vhodnými pre profesionálne použitie.

Prevod textu na reč sa vzťahuje na všeobecný proces konverzie textu na hovorený zvuk, zatiaľ čo AI hlasový komentár sa viac zameriava na vytváranie prirodzeného, expresívneho a produkčne pripraveného zvuku na použitie v médiách, marketingu a obsahu.

AI hlasové nahrávky môžu nahradiť ľudských hlasových hercov pri mnohých úlohách, ako sú vysvetľujúce videá, produktové demonštrácie alebo interné školenia. Ľudský hlasový talent je však stále preferovaný pre projekty vyžadujúce emocionálne odtiene a výkon.

Áno, používanie AI hlasových nahrávok je legálne, pokiaľ máte právo používať text a dodržiavate licenčné podmienky hlasového softvéru. Vždy sa uistite, že obsah neporušuje autorské práva ani nenapodobňuje skutočné osoby.